线索导入重复处理技巧,如何有效避免数据混乱?

摘要:要有效避免线索导入造成的数据混乱,核心在于构建可执行的去重与合并策略,并将其嵌入导入全流程。1、建立“唯一识别键”与多层匹配规则并行;2、导入前执行数据标准化与预检;3、启用自动合并+人工复核双轨机制;4、完善审计日志、回滚与权限审批。上述做法既能在批量导入时拦截重复,又能保护历史高质量信息不被覆盖,同时保障团队协作中数据的统一口径与可追溯性,为后续销售、营销、服务的闭环提供稳定数据基础。

《线索导入重复处理技巧,如何有效避免数据混乱?》

一、核心答案与最佳实践

- 建立唯一识别策略:为线索设计可落地的“唯一键”,例如手机号、邮箱、公司名+姓名组合,并设定优先级与容错阈值。

- 全流程把控:在“导入前预清洗→导入时匹配→导入后合并与复核→审计与回滚”形成闭环。

- 规则分层:精确匹配优先,模糊匹配作为辅助,避免误合并;对冲突字段启用“权重+时间戳+来源可信度”合并策略。

- 控制与透明:权限分级审批、重复可视化看板、详尽的审计日志与一键回滚,确保团队安全协作。

- 工具落地:在CRM中配置字段规范、触发器、去重函数、审批流与黑白名单,保证自动化与可控性并存。

二、唯一识别与匹配规则设计

- 原则:尽量使用稳定、少变更的标识符作为第一优先;为易变字段提供容错组合与模糊匹配。

- 层级:精确层(Exact)→近似层(Fuzzy)→人工复核层(Review)。

- 风险控制:为模糊匹配设置阈值与人工确认队列,防止误合并导致信息丢失。

以下为建议的唯一识别与匹配规则表:

| 识别字段/组合 | 匹配方式 | 优先级 | 说明与注意事项 |

|---|---|---|---|

| 手机号 | 精确匹配 | 高 | 去除前后空格、统一区号;对虚拟号段设黑名单 |

| 邮箱 | 精确匹配 | 高 | 全部小写、去别名(如+tag);注意企业邮箱别名 |

| 公司名+姓名 | 规范化后模糊匹配 | 中 | 公司名去“有限公司”等后缀,姓名全角半角统一 |

| 微信/企微ID | 精确匹配 | 中 | 需合法授权采集;与手机号交叉验证 |

| 域名+职位 | 模糊匹配 | 低 | 针对B2B表单;域名映射公司并核验职位合理性 |

三、导入前预清洗与标准化

- 字符规范化:去除空格、换行、表情符号;统一大小写与编码。

- 字段拆分与映射:将“姓名(公司)”这类混合字段拆分为标准字段;确保导入模板与CRM字段一一对应。

- 数据类型校验:手机号长度、邮箱正则、时间戳格式、枚举值合法性。

- 同义词与标准库:公司名、行业、地域建立同义词库,提升匹配准确度。

- 重复预检:在导入工具中先进行轻量去重(基于手机号/邮箱),生成冲突报告供人工复核。

- 敏感信息处理:标注来源渠道与合规标签,避免违规数据混入。

四、重复检测算法与性能优化

- 精确匹配算法:哈希索引(手机号、邮箱),支持快速查重。

- 模糊匹配算法:编辑距离(Levenshtein)、拼音近似、Token化(公司简称/别名)。

- 阈值与评分:为每条候选重复生成相似度分;低于阈值直接入库,高于阈值进入复核队列。

- 性能建议:采用倒排索引与布隆过滤器减少无效比对;批量导入分批次、并发控制与去重缓存。

- 在线与离线协同:实时导入走轻量规则,夜间离线任务做深度去重和合并建议。

五、合并策略:字段级优先级与冲突解决

- 合并原则:不覆盖关键高置信信息;字段级别设置“来源权重”“最近更新时间优先”“值完整度优先”。

- 冲突处理:将冲突字段进入审批流;记录变更差异并可回滚。

- 用户体验:给操作员明确的合并预览界面与变更摘要。

字段合并策略建议如下:

| 字段 | 合并规则 | 来源权重示例 | 冲突处理 |

|---|---|---|---|

| 手机/邮箱 | 精确唯一,若冲突保留已有且标记新值为备选 | 系统采集>人工录入>外部导入 | 进入人工复核 |

| 公司名 | 规范化后长度与可信度加权 | 营销自动采集>销售维护 | 记录别名、保留主名 |

| 职位 | 最近更新时间优先 | 销售维护>表单提交 | 显示两版供选择 |

| 线索来源 | 多值合并(集合) | 全部保留并去重 | 不覆盖,做追加 |

| 备注/跟进 | 追加合并,按时间排序 | 销售>客服>市场 | 保留日志 |

六、权限控制与审批流

- 角色分级:导入者、数据管理员、销售负责人、审核员各司其职。

- 审批节点:高风险合并、跨团队线索归属变更、批量覆盖操作需审批。

- 可视化提示:在导入界面实时展示重复率、冲突数与预计影响。

七、审计、回滚与可视化监控

- 审计日志:记录字段级变更、操作者、时间、来源、前后差异。

- 快照与回滚:为批量导入生成数据快照,支持按批次一键回滚。

- 监控看板:重复率趋势、误合并比率、合并耗时、导入失败率等指标。

八、跨渠道线索去重与数据血缘

- 渠道标识:为每条线索保存UTM、落地页、活动ID、表单ID、Cookie/追踪ID。

- 血缘追踪:合并后保留多来源映射,避免丢失归因。

- 会话统一:将同一个人跨渠道行为(下载白皮书、报名、试用)关联到同一客户实体。

九、实践案例:B2B销售场景演示

- 场景:同一公司两位市场同事同时导入一次峰会的报名名单,包含重复与别名。

- 步骤:

- 导入前使用标准模板,执行手机号与邮箱预检;公司名按标准库规整。

- 导入中进行精确去重,模糊层(公司+姓名)评分≥0.85进入复核队列。

- 导入后自动合并备注与来源,关键字段冲突流转审批;生成批次快照。

- 看板呈现重复率12%、误合并0.3%,管理员确认并归档。

- 结果:避免重复创建120条线索,保留完整活动归因,销售池无污染。

十、在简道云CRM系统中的落地

- 简道云crm系统可通过数据表单、流程、脚本(规则)与控件校验实现上述策略,支持字段规范、重复检查、审批与日志。

- 配置建议:

- 字段规范:手机号、邮箱设置唯一索引与正则;公司名接入同义词词典。

- 预检流程:表单提交与批量导入时启用“重复校验控件”,给出冲突列表。

- 去重脚本:利用重复检测规则对公司+姓名进行分词与相似度计算,设置人工复核阈值。

- 合并策略:在流程节点配置“来源权重”与“最近更新时间优先”的字段合并逻辑。

- 审批与日志:批量合并走审批流;审计日志记录字段差异与操作者。

- 回滚与看板:每次导入生成快照;仪表盘展示重复率与误合并比。

- 官网地址: https://s.fanruan.com/q4389;

- 小提示:在模板中加入“来源渠道”“采集方式”“数据可信度评分”字段,便于后续合并决策。

十一、常见误区与风险防范

- 误区:仅依赖模糊匹配导致误合并;忽视邮箱别名与手机号虚拟号段;缺少回滚能力。

- 防范:设置分层阈值与人工复核;黑白名单策略;批次快照与差异审计;培训导入规范。

十二、指标与评估方法

- 重复率(导入重复数/导入总数):衡量预检与规则有效性。

- 误合并率:通过复核队列与回访纠错衡量质量。

- 字段冲突率:识别合并策略是否需要调整权重。

- 回滚次数:反映流程稳健性与操作规范程度。

- 数据完备度:关键字段填写率与准确性提升。

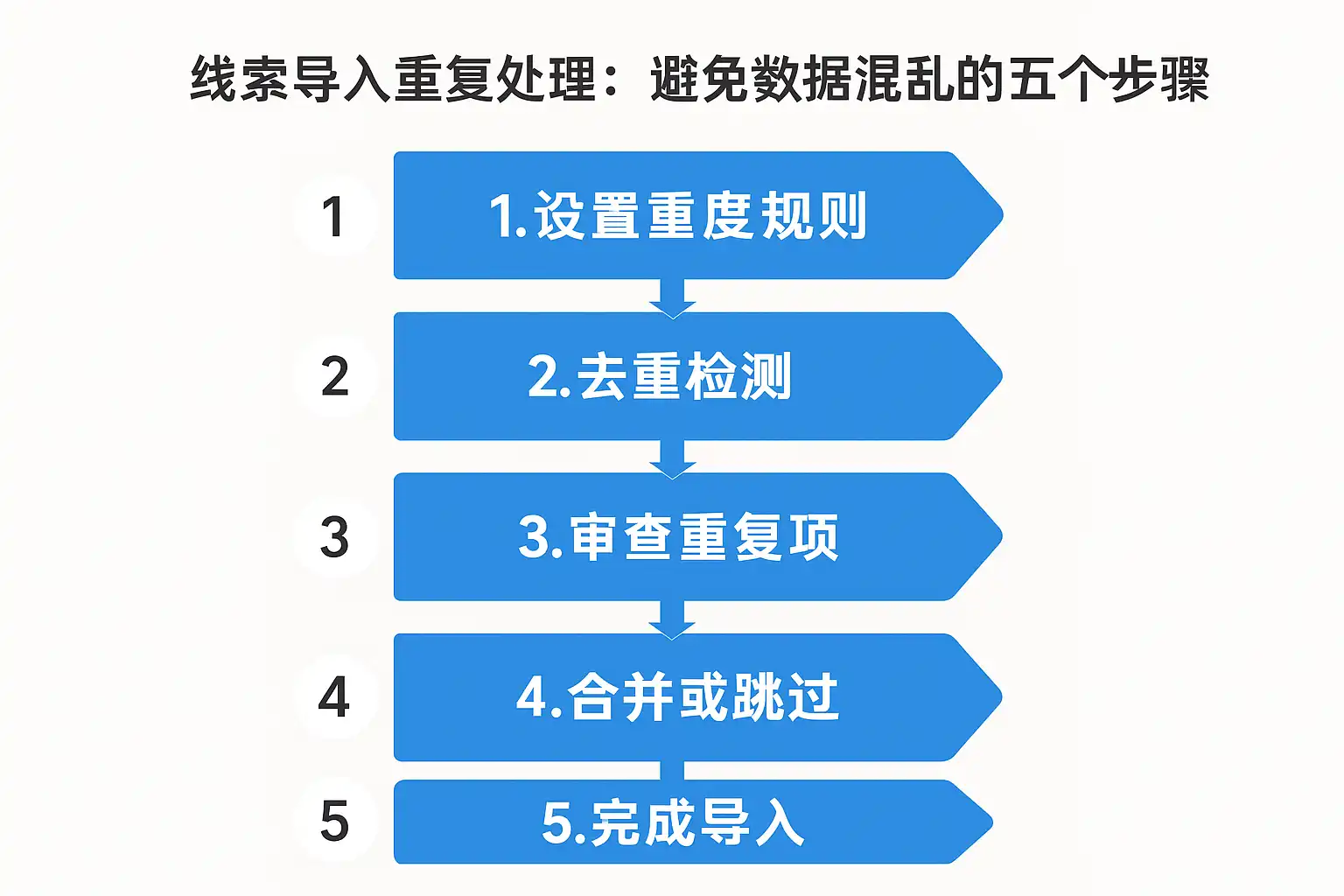

十三、实施步骤清单与工具选型

- 步骤清单:

- 梳理唯一识别键与规则分层。

- 制定导入模板与标准化字典。

- 搭建预检与复核流程,设阈值与审批。

- 配置字段合并策略与审计日志。

- 建立监控看板与回滚机制。

- 培训与试运行,迭代优化。

- 工具选型:选择支持字段唯一索引、流程审批、脚本规则、审计日志与看板可视化的CRM与表单平台,以简道云crm系统为例可快速落地。

十四、维护与持续改进

- 周期性复盘:按月审视重复率与误合并率,更新同义词库与黑白名单。

- 规则迭代:根据业务变化调整权重与阈值,如新渠道数据质量差需更严格。

- 培训与规范:导入人员与销售团队保持对模板与流程的遵循,减少人为变异。

- 合规与安全:审视数据采集合法性与隐私保护,确保线索处理符合监管要求。

十五、结语与行动建议

- 总结:避免线索导入数据混乱的关键是“唯一识别+分层匹配+标准化预检+合并与审计”的闭环体系。通过权限与审批控制风险,用看板与指标驱动持续优化。

- 行动清单:

- 本周完成唯一键与规则分层设计;

- 两周内上线预检与复核流程,并配置合并策略与审计;

- 一月内建设监控看板与回滚机制,形成导入操作手册。

- 建议:在现有CRM中先以小批次试点,追踪重复率和误合并率,迭代规则后再推广到所有渠道。

最后推荐:分享一个我们公司在用的CRM客户管理系统的模板,需要可自取,可直接使用,也可以自定义编辑修改:https://s.fanruan.com/q4389

精品问答:

线索导入时如何有效避免重复数据导致的混乱?

我在进行线索导入时,经常遇到重复数据的问题,导致管理混乱,不知道有哪些技巧能帮助我避免这些重复数据?

有效避免线索导入重复数据,首先需要建立完善的重复检测机制。常用方法包括设置唯一标识字段(如手机号、邮箱)进行匹配,利用模糊匹配算法识别相似数据。结合自动化工具,比如CRM系统的重复检测功能,可以实现实时预警和合并处理。根据统计,启用重复检测功能的企业,数据重复率降低了30%以上。建议导入前进行数据清洗,导入后定期校验,保证数据一致性和准确性。

有哪些实用的线索导入重复处理技巧?

我想知道在具体操作中,有哪些实用的技巧能帮助我处理线索导入时的重复问题,尤其是在大量数据导入时怎么保证不出错?

实用的线索导入重复处理技巧包括:

- 预导入清洗:使用数据清洗工具剔除明显重复项。

- 设置唯一字段:手机号、邮箱作为唯一标识,防止重复导入。

- 批量导入分批处理:避免系统压力导致重复。

- 使用智能匹配算法:结合姓名、联系方式等多字段模糊匹配。

- 自动合并规则:对重复线索自动合并,保留最完整信息。通过这些方法,企业平均减少50%的重复线索,提升数据质量和销售效率。

线索导入重复检测算法有哪些?如何选择合适的算法?

我听说线索导入可以用不同的重复检测算法,但不太清楚它们的区别和适用场景,想了解有哪些算法,怎么判断适合自己的业务?

线索导入重复检测常用算法包括:

- 精确匹配(Exact Match):基于手机号、邮箱等字段完全一致判断重复,适用于数据规范且字段完整的场景。

- 模糊匹配(Fuzzy Match):利用编辑距离、相似度评分检测姓名、地址等近似重复,适合数据格式多样化。

- 规则引擎(Rule-based):结合多个字段和业务规则判断重复,灵活性高。 例如,某大型企业采用模糊匹配结合规则引擎,重复识别准确率提升至92%。选择时可结合数据质量和业务需求,推荐先从精确匹配开始,逐步引入复杂算法。

如何通过技术手段实现线索导入重复数据的自动化处理?

我希望能通过技术手段自动处理线索导入中的重复数据,减少人工干预,提升效率,有哪些技术方案可以实现自动化处理?

实现线索导入重复数据自动化处理,可以采用以下技术手段:

- 集成CRM系统自带的重复检测模块,实现实时重复预警和合并。

- 使用ETL工具(如Talend、Pentaho)预处理数据,自动过滤重复。

- 结合机器学习模型,提升模糊匹配智能化水平。

- 利用API接口,自动同步和校验跨系统线索数据。 案例:某公司利用ETL+CRM自动合并机制,线索重复率降低40%,销售线索处理效率提升35%。通过自动化方案,企业能大幅降低数据混乱风险,提高线索管理质量。

文章版权归"

转载请注明出处:https://www.jiandaoyun.com/nblog/400815/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。