1、GitHub 上有许多优秀的 Java 爬虫项目,以下是几个值得关注的项目:

- WebMagic:一个高度可扩展的爬虫框架,支持多线程抓取,页面解析,数据存储等功能。

- Crawler4j:一个开源的 Java 爬虫框架,易于使用,支持多线程。

- Jsoup:一个用于解析 HTML,处理数据并与网络交互的 Java 库。

- Apache Nutch:一个高度可扩展的开源网络爬虫软件项目。

- StormCrawler:一个用于实时爬取和处理大规模网页数据的开源项目。

这些项目各有特色,能够满足不同的爬虫需求。下面将详细介绍这些项目的特点和使用方法。

一、WEBMAGIC

WebMagic 是一个灵活、简洁且高度可扩展的 Java 爬虫框架,支持多线程抓取、页面解析和数据存储。它的主要特点包括:

- 简单易用:只需编写少量代码就可以实现复杂的爬虫任务。

- 高效稳定:支持多线程抓取,具有良好的稳定性和性能。

- 可扩展性强:支持插件式扩展,可以根据需要添加自定义功能。

WebMagic 的使用步骤:

- 创建爬虫类:继承

WebMagic的PageProcessor接口,实现其process方法。 - 配置爬虫:设置爬取的 URL、页面解析规则和数据存储方式。

- 启动爬虫:调用

Spider类的run方法启动爬虫。

public class MyCrawler implements PageProcessor {

private Site site = Site.me().setRetryTimes(3).setSleepTime(100);

@Override

public void process(Page page) {

// 解析页面,获取目标数据

page.putField("title", page.getHtml().xpath("//title").toString());

}

@Override

public Site getSite() {

return site;

}

public static void main(String[] args) {

Spider.create(new MyCrawler())

.addUrl("http://example.com")

.thread(5)

.run();

}

}

二、CRAWLER4J

Crawler4j 是一个开源的 Java 爬虫框架,主要用于抓取网页内容和链接。它具有以下特点:

- 易于使用:提供简单的 API,便于快速开发爬虫程序。

- 多线程支持:支持多线程抓取,提升爬取效率。

- 灵活配置:支持自定义配置,如抓取深度、延迟时间等。

Crawler4j 的使用步骤:

- 创建爬虫类:继承

WebCrawler类,实现其visit方法。 - 配置爬虫控制器:设置爬取的 URL、抓取深度和线程数等参数。

- 启动爬虫:调用

CrawlController类的start方法启动爬虫。

public class MyCrawler extends WebCrawler {

@Override

public void visit(Page page) {

String url = page.getWebURL().getURL();

if (page.getParseData() instanceof HtmlParseData) {

HtmlParseData htmlParseData = (HtmlParseData) page.getParseData();

String text = htmlParseData.getText();

String html = htmlParseData.getHtml();

Set<WebURL> links = htmlParseData.getOutgoingUrls();

// 处理页面内容

}

}

public static void main(String[] args) throws Exception {

CrawlConfig config = new CrawlConfig();

config.setCrawlStorageFolder("data/crawl/root");

config.setMaxDepthOfCrawling(2);

config.setMaxPagesToFetch(1000);

PageFetcher pageFetcher = new PageFetcher(config);

RobotstxtConfig robotstxtConfig = new RobotstxtConfig();

RobotstxtServer robotstxtServer = new RobotstxtServer(robotstxtConfig, pageFetcher);

CrawlController controller = new CrawlController(config, pageFetcher, robotstxtServer);

controller.addSeed("http://example.com");

controller.start(MyCrawler.class, 5);

}

}

三、JSOUP

Jsoup 是一个用于解析 HTML,处理数据并与网络交互的 Java 库。它的主要特点包括:

- 强大的 HTML 解析能力:支持 DOM、CSS 选择器和 jQuery 样式的选择器。

- 简洁易用的 API:方便快速处理 HTML 内容。

- 灵活的数据提取:支持从 HTML 文档中提取数据,生成新的 HTML 文档等。

Jsoup 的使用步骤:

- 连接到网页:使用

Jsoup.connect方法连接到目标网页。 - 解析 HTML:使用

Jsoup.parse方法解析 HTML 内容。 - 提取数据:使用选择器从 HTML 文档中提取所需数据。

public class JsoupExample {

public static void main(String[] args) throws IOException {

Document doc = Jsoup.connect("http://example.com").get();

String title = doc.title();

Elements links = doc.select("a[href]");

System.out.println("Title: " + title);

for (Element link : links) {

System.out.println("Link: " + link.attr("href"));

System.out.println("Text: " + link.text());

}

}

}

四、APACHE NUTCH

Apache Nutch 是一个高度可扩展的开源网络爬虫软件项目,适用于大规模数据抓取。其主要特点包括:

- 高度可扩展:支持插件式架构,可以根据需要添加自定义插件。

- 与 Hadoop 集成:支持与 Hadoop 集成,适用于大规模数据处理。

- 灵活配置:支持多种配置选项,满足不同的抓取需求。

Apache Nutch 的使用步骤:

- 下载和配置 Nutch:从官网下载 Nutch,并进行配置。

- 定义种子 URL:在

seeds.txt文件中定义要抓取的初始 URL。 - 运行 Nutch:使用命令行工具运行 Nutch,开始爬取数据。

# 下载 Nutch

wget http://apache.mirrors.tds.net/nutch/1.18/apache-nutch-1.18-bin.tar.gz

tar -xzf apache-nutch-1.18-bin.tar.gz

配置 Nutch

cd apache-nutch-1.18

vi conf/nutch-site.xml

添加种子 URL

vi urls/seeds.txt

echo "http://example.com" >> urls/seeds.txt

运行 Nutch

bin/nutch inject crawl/crawldb urls

bin/nutch generate crawl/crawldb crawl/segments

bin/nutch fetch crawl/segments/segment_id

bin/nutch parse crawl/segments/segment_id

bin/nutch updatedb crawl/crawldb crawl/segments/segment_id

五、STORMCRAWLER

StormCrawler 是一个用于实时爬取和处理大规模网页数据的开源项目。其主要特点包括:

- 实时数据处理:基于 Apache Storm,支持实时数据处理。

- 高度可扩展:支持水平扩展,适用于大规模数据抓取。

- 丰富的功能:支持 URL 去重、内容解析、数据存储等功能。

StormCrawler 的使用步骤:

- 下载和配置 StormCrawler:从官网下载 StormCrawler,并进行配置。

- 定义爬虫拓扑:编写爬虫拓扑,定义数据流和处理逻辑。

- 运行爬虫:使用 Storm 提交爬虫拓扑,开始爬取数据。

public class MyCrawlerTopology {

public static void main(String[] args) throws Exception {

Config conf = new Config();

conf.setDebug(true);

TopologyBuilder builder = new TopologyBuilder();

builder.setSpout("spout", new URLSpout(), 5);

builder.setBolt("fetcher", new FetcherBolt(), 10).shuffleGrouping("spout");

builder.setBolt("parser", new ParserBolt(), 10).shuffleGrouping("fetcher");

builder.setBolt("indexer", new IndexerBolt(), 10).shuffleGrouping("parser");

StormSubmitter.submitTopology("my-crawler", conf, builder.createTopology());

}

}

总结:

以上介绍的五个 Java 爬虫项目各有特点,适用于不同的爬虫需求:

- WebMagic:适合需要快速开发和高效抓取的场景。

- Crawler4j:适合需要简单易用和多线程支持的场景。

- Jsoup:适合需要强大 HTML 解析和数据处理的场景。

- Apache Nutch:适合需要大规模数据抓取和处理的场景。

- StormCrawler:适合需要实时数据处理和大规模爬取的场景。

在选择爬虫项目时,可以根据具体需求和项目特点进行选择。此外,爬虫项目在实际使用中,还需要考虑数据存储、去重、反爬等问题,可以结合其他工具和技术进行综合解决。

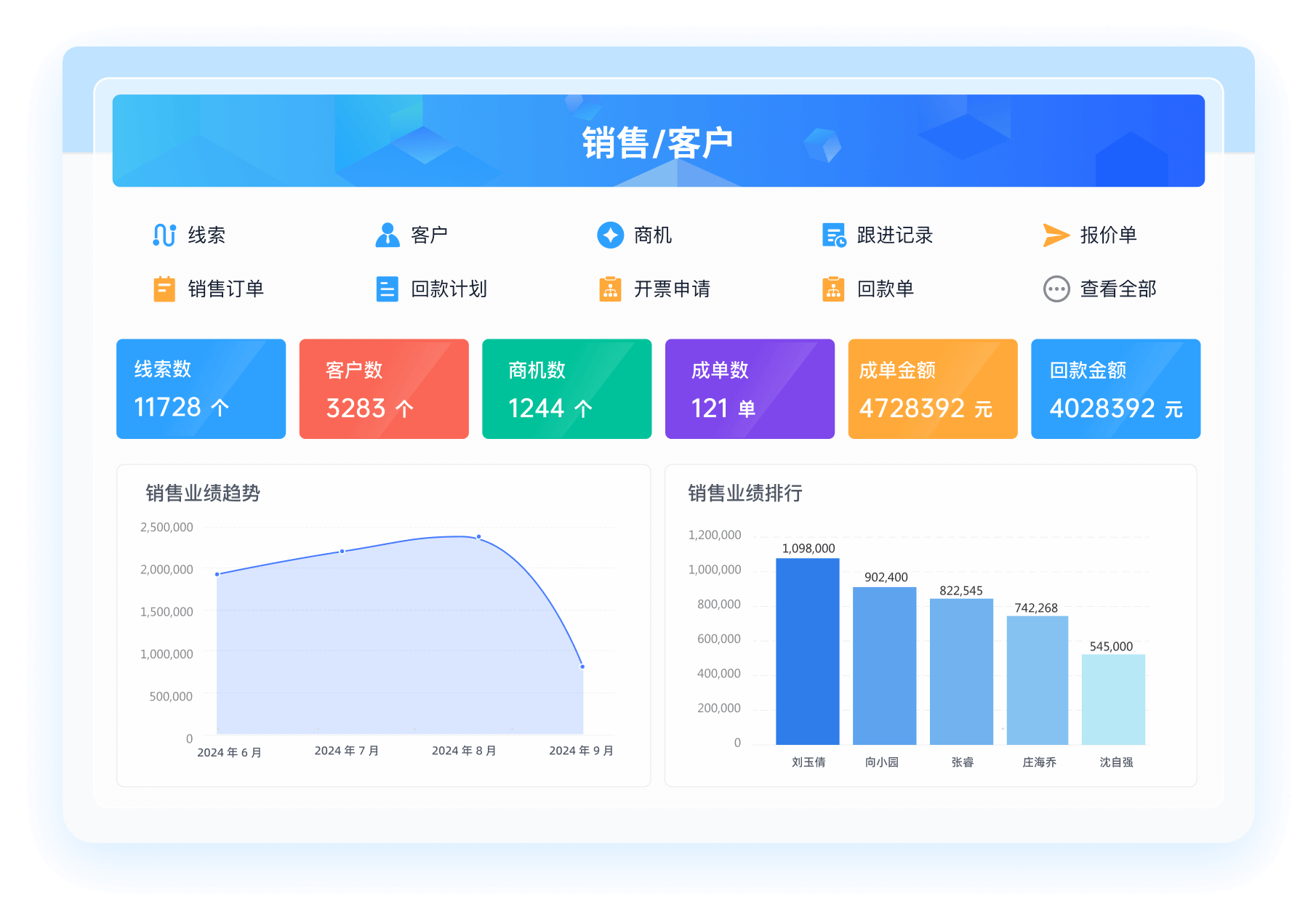

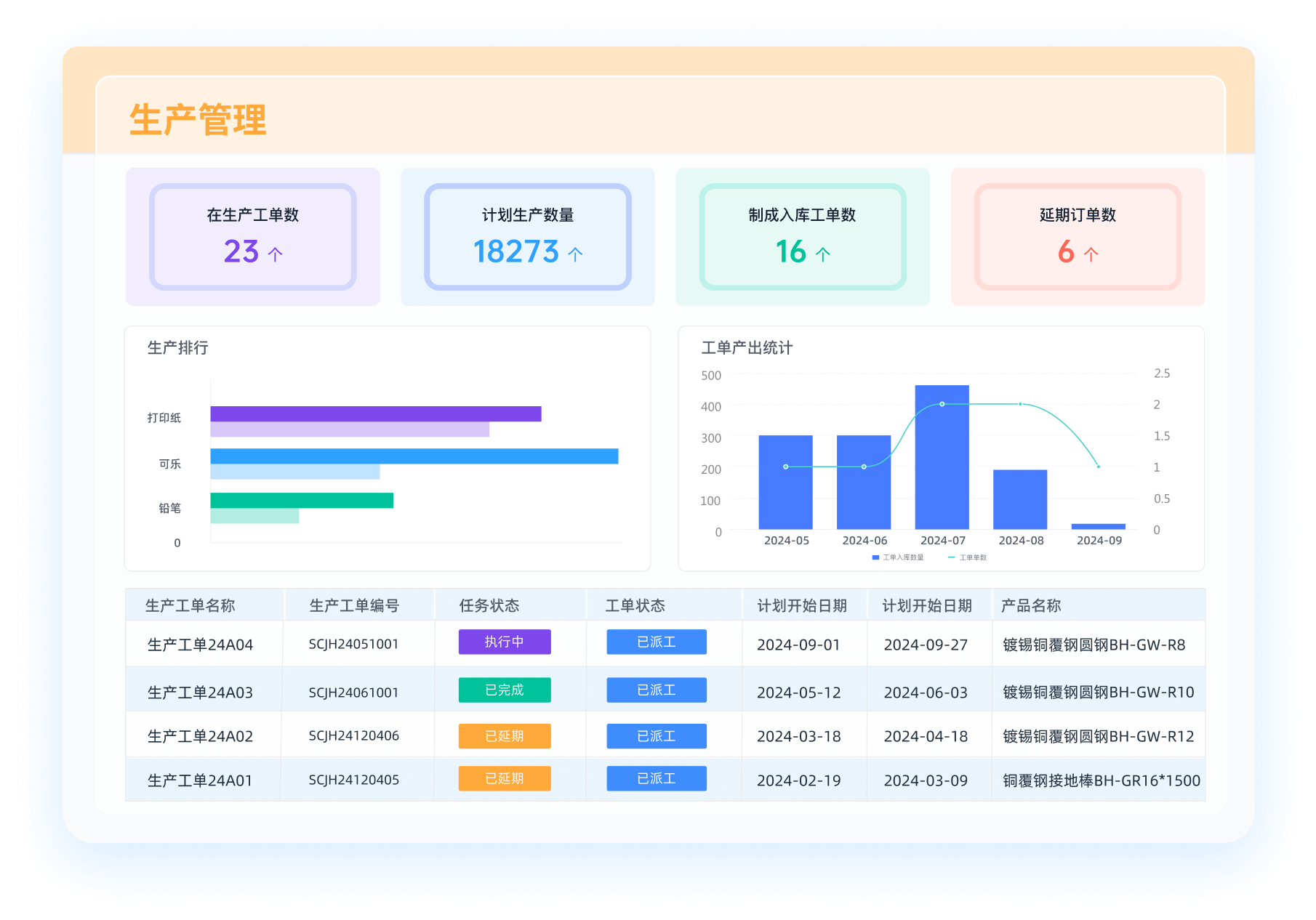

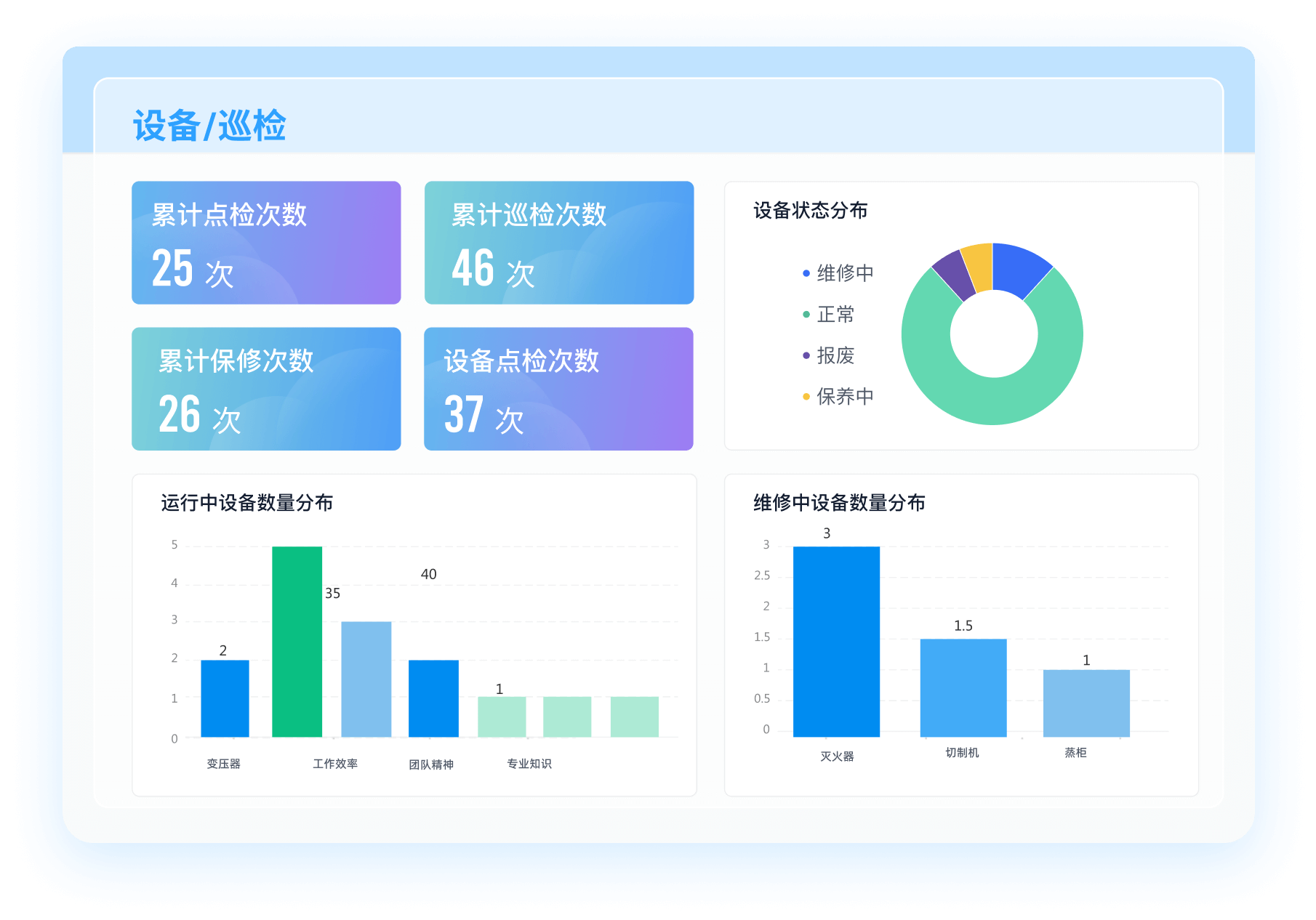

访问简道云财务管理模板以了解更多企业管理解决方案: https://s.fanruan.com/kw0y5;

相关问答FAQs:

在 GitHub 上有哪些优秀的 Java 爬虫项目?

在 GitHub 上,有许多优秀的 Java 爬虫项目,涵盖了不同的功能和应用场景。以下是一些广受欢迎且功能强大的 Java 爬虫项目,适合不同需求的开发者使用。

-

WebMagic

WebMagic 是一个灵活且易于使用的 Java 爬虫框架,适合各种规模的爬虫项目。它提供了简单的 API,支持多线程爬取、数据抽取以及存储等功能。WebMagic 的核心组件包括爬虫、页面处理器和数据抽取器,使用者可以轻松地定义爬虫行为。该框架还支持对抗反爬虫机制,用户可以通过配置代理 IP、设置请求间隔等方式来提高爬虫的稳定性和效率。WebMagic 在 GitHub 上有着活跃的社区支持,用户可以通过文档和示例代码快速上手。 -

Jaunt

Jaunt 是一个功能强大的 Java 爬虫库,特别适用于处理 HTML 和 XML 文档。它提供了简洁的 API,支持网页抓取、数据提取和表单提交等功能。Jaunt 的一个显著特点是它能够通过 CSS 选择器来提取数据,这使得数据抽取变得更加直观和高效。与其他爬虫框架相比,Jaunt 的学习曲线较低,适合初学者和中级开发者使用。此外,Jaunt 还支持 JavaScript 的执行,这对于需要动态加载内容的网站来说非常重要。 -

Apache Nutch

Apache Nutch 是一个开源的网页爬虫框架,旨在构建大规模的网络搜索引擎。它基于 Hadoop 平台,支持分布式爬取和数据存储。Nutch 提供了强大的扩展性,用户可以根据需求自定义爬虫逻辑和数据存储方式。它还支持多种数据格式的解析,包括 HTML、PDF、Word 等,适合需要处理各种文档类型的应用场景。由于其强大的功能和灵活的架构,Apache Nutch 在业界得到了广泛的应用,特别是在大数据处理和搜索引擎领域。

Java 爬虫项目的选择标准是什么?

在选择 Java 爬虫项目时,开发者可以考虑以下几个标准,以确保所选项目能有效满足需求:

- 功能需求: 根据项目的具体需求,评估爬虫框架是否支持所需的功能,如数据抽取、页面处理、反爬虫策略等。

- 易用性: 框架的学习曲线是否平滑,是否提供了良好的文档和社区支持。对于初学者来说,选择一个易于上手的框架尤为重要。

- 性能: 爬虫的性能直接影响抓取速度和数据处理能力。比较不同框架的多线程支持和并发处理能力,选择性能较优的框架。

- 扩展性: 评估框架的扩展能力,是否支持自定义插件或功能扩展,以便未来项目需求变化时能灵活调整。

- 社区支持: 选择一个有活跃社区和开发者支持的项目,可以帮助解决开发过程中遇到的问题,获取更多的资源和示例。

如何使用 Java 爬虫项目进行网页数据抓取?

使用 Java 爬虫项目进行网页数据抓取的步骤通常包括以下几个环节:

-

环境准备: 首先需要在本地环境中安装 Java 开发工具包 (JDK),并配置好相应的开发环境。接着,下载所选爬虫框架的库文件并添加到项目中。

-

创建爬虫项目: 根据所选框架的文档,创建一个新的 Java 项目。在项目中设置爬虫的基本配置,如请求 URL、数据存储方式等。

-

定义页面处理器: 页面处理器是爬虫的核心部分,负责处理抓取到的网页内容。根据需要,使用框架提供的 API 定义数据抽取逻辑,提取所需的信息。

-

配置爬虫参数: 配置爬虫的请求参数,包括请求间隔、用户代理、代理 IP 等,以提高爬虫的稳定性和效率。

-

执行爬虫: 运行爬虫项目,监控爬虫的抓取过程,并查看抓取到的数据。根据需要,可以对爬虫逻辑进行调整和优化。

-

数据存储与分析: 将抓取到的数据存储到数据库或文件系统中,后续可以使用数据分析工具对数据进行处理和分析。

总结

GitHub 上的 Java 爬虫项目为开发者提供了丰富的选择,不同的框架适用于不同的应用场景。在选择合适的爬虫项目时,开发者应根据项目的具体需求、性能、易用性和社区支持等因素进行综合考虑。通过合理利用这些工具,开发者可以高效地抓取和处理网页数据,推动项目的成功实施。

最后分享一下我们公司在用的项目管理软件的模板,可直接用,也可以自主修改功能: https://s.fanruan.com/kw0y5;

阅读时间:9 分钟

阅读时间:9 分钟  浏览量:9012次

浏览量:9012次

《零代码开发知识图谱》

《零代码开发知识图谱》

《零代码

新动能》案例集

《零代码

新动能》案例集

《企业零代码系统搭建指南》

《企业零代码系统搭建指南》