爬虫管理软件哪个好?推荐 4 款高效工具!

在爬取和管理数据时,选择合适的爬虫管理软件至关重要。以下是 4 款优秀的爬虫管理软件,它们各具特色,适用于不同需求:

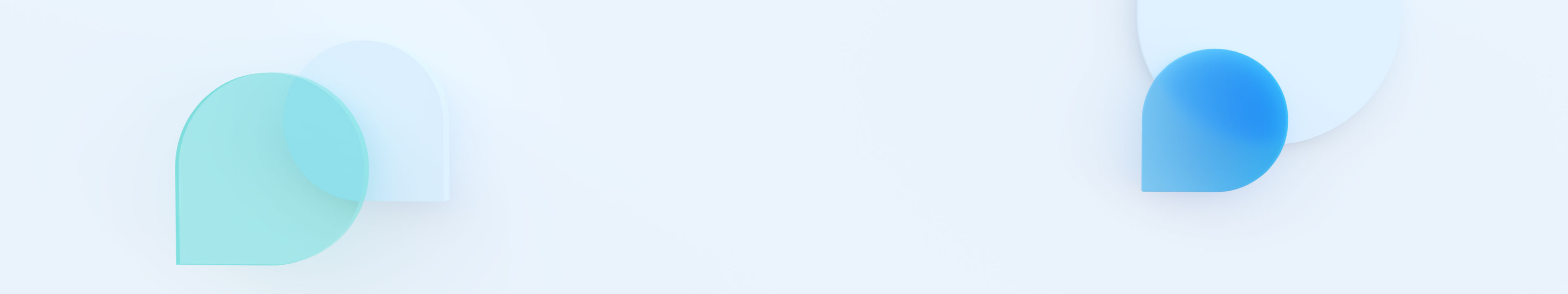

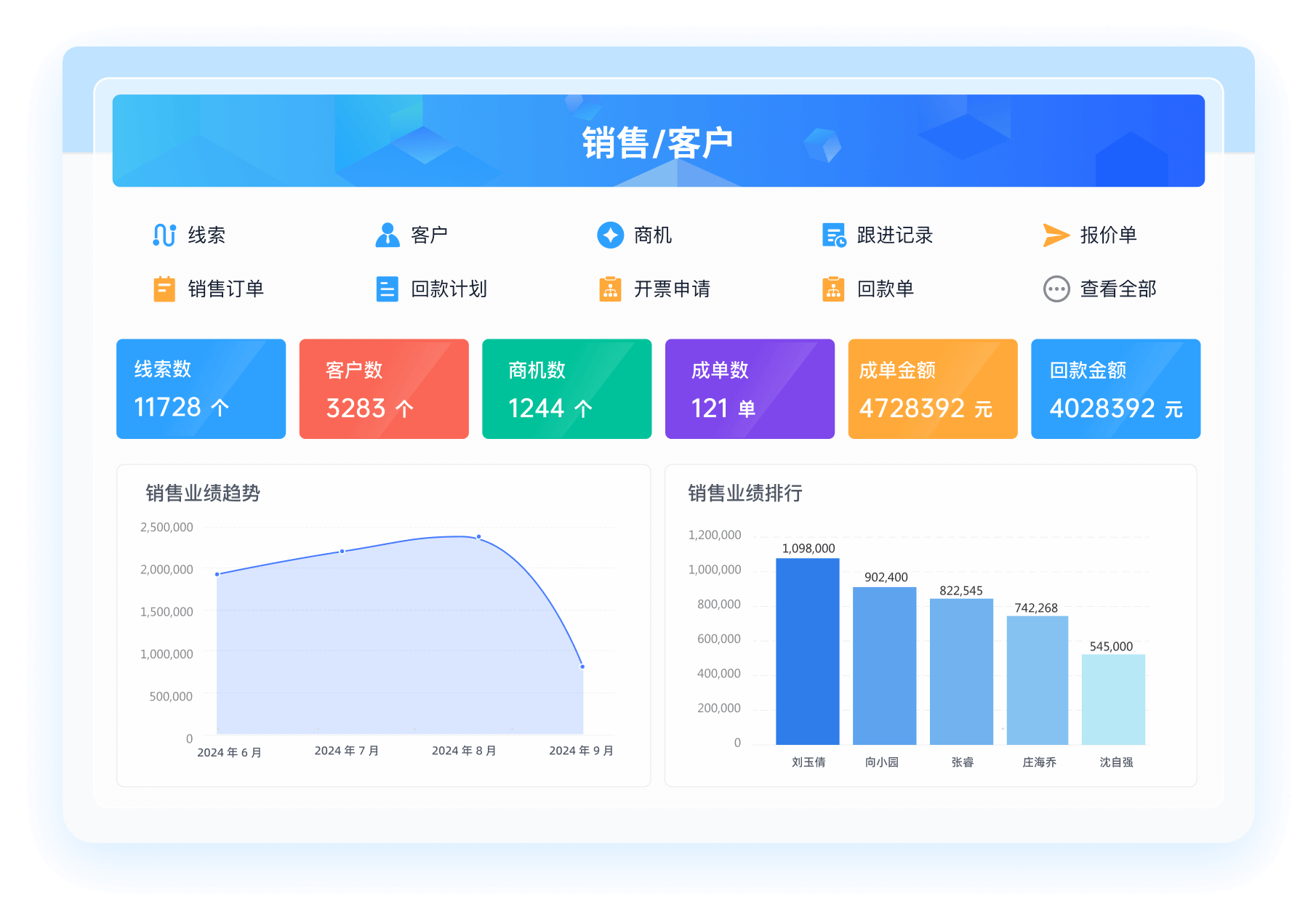

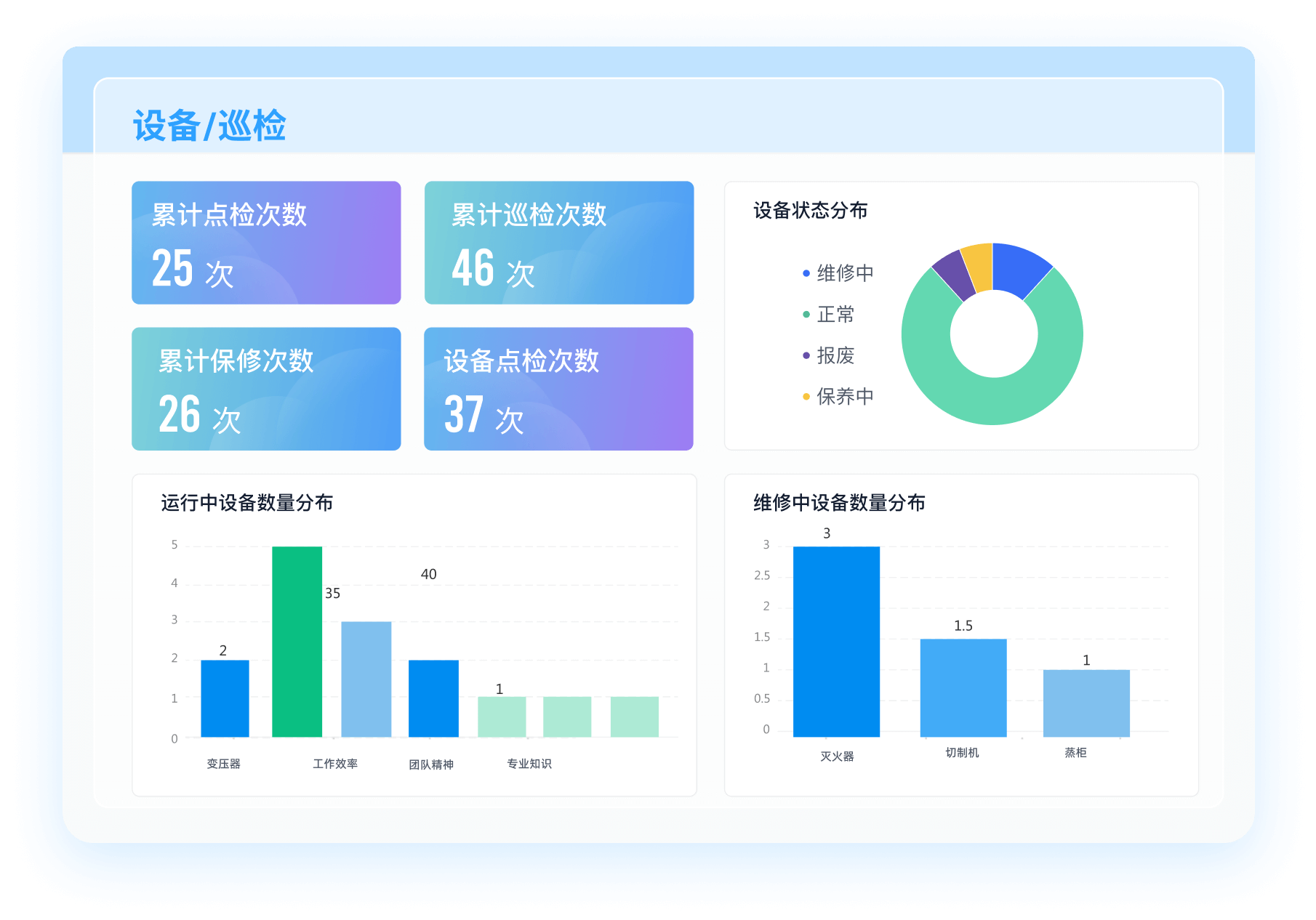

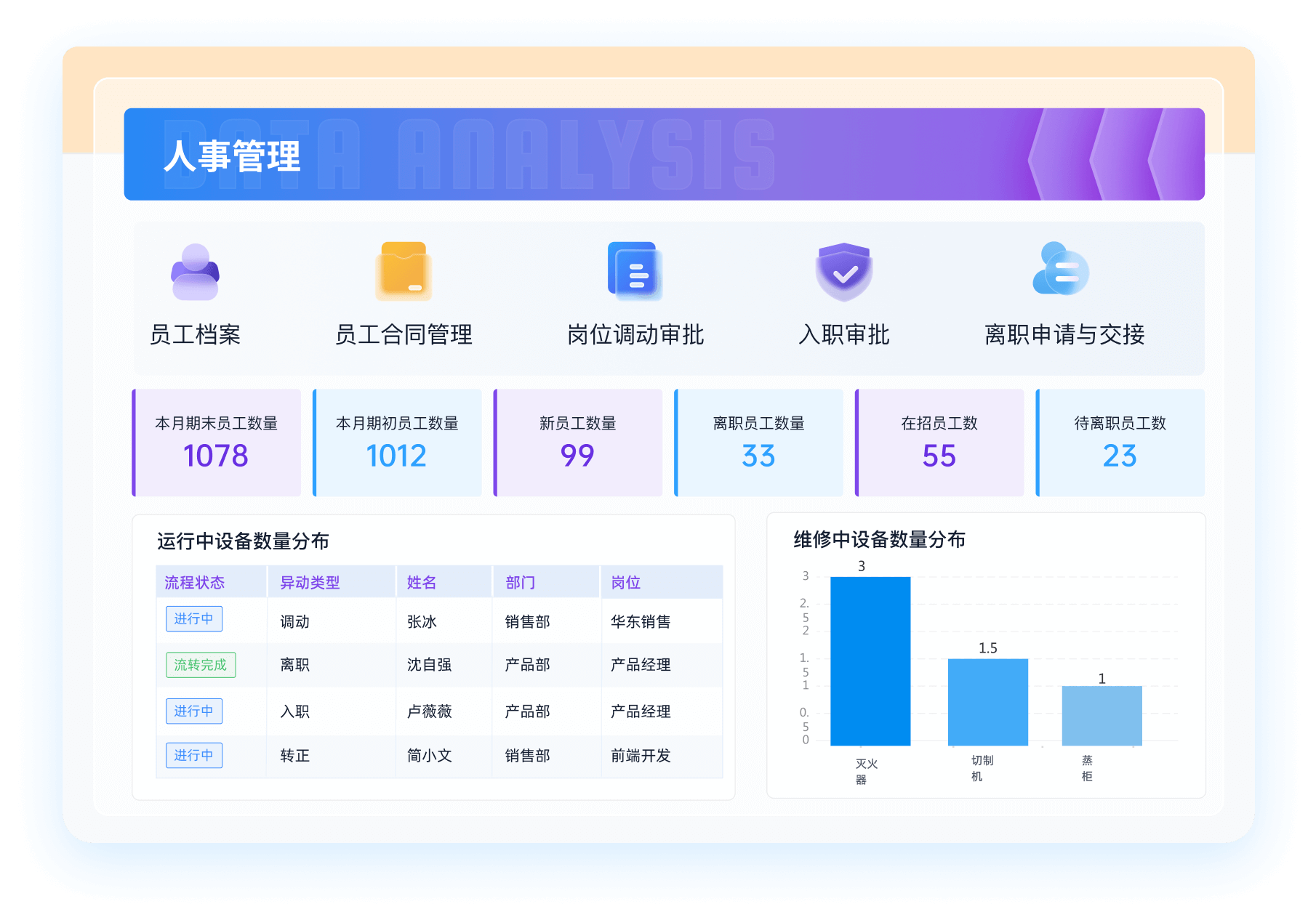

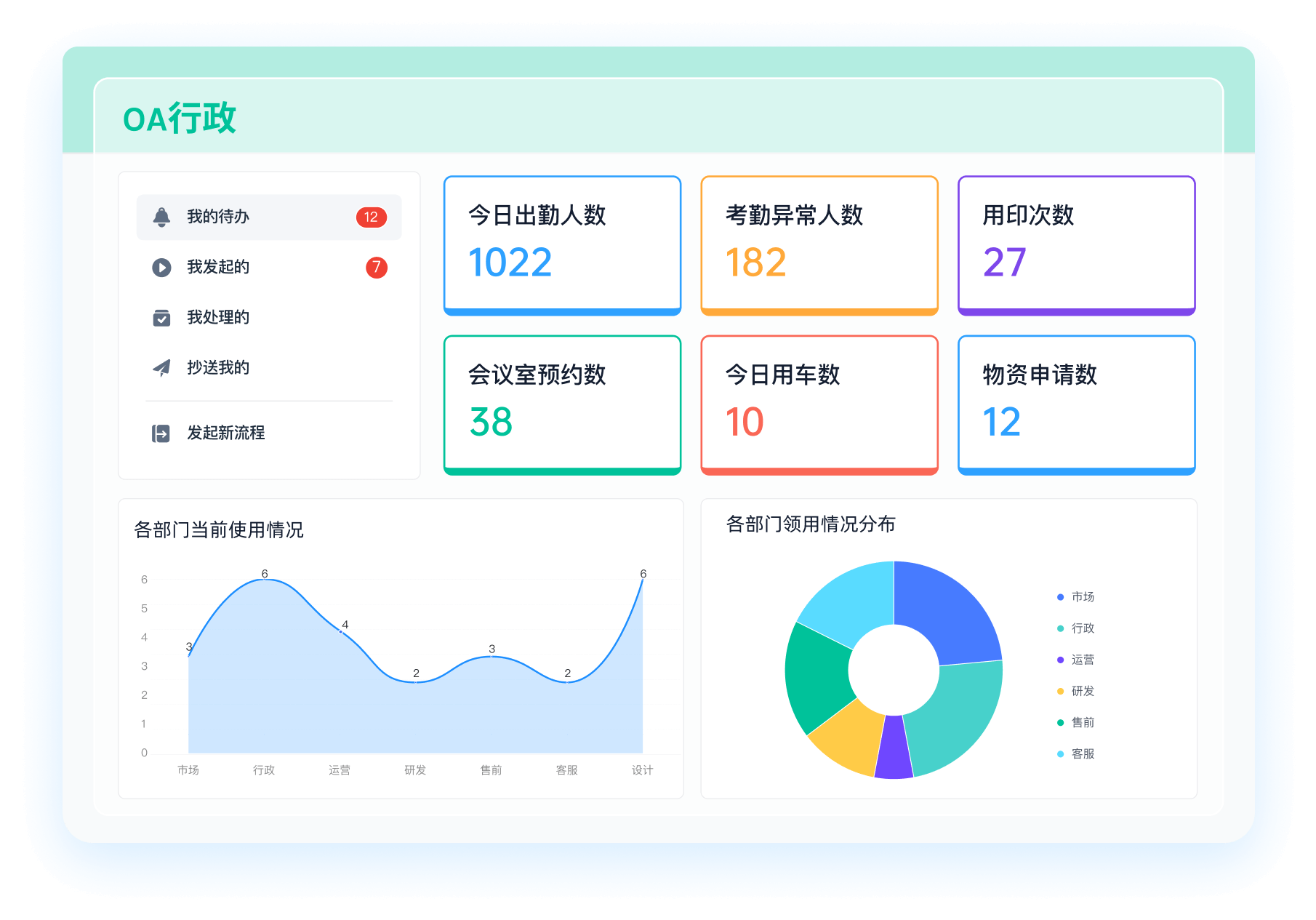

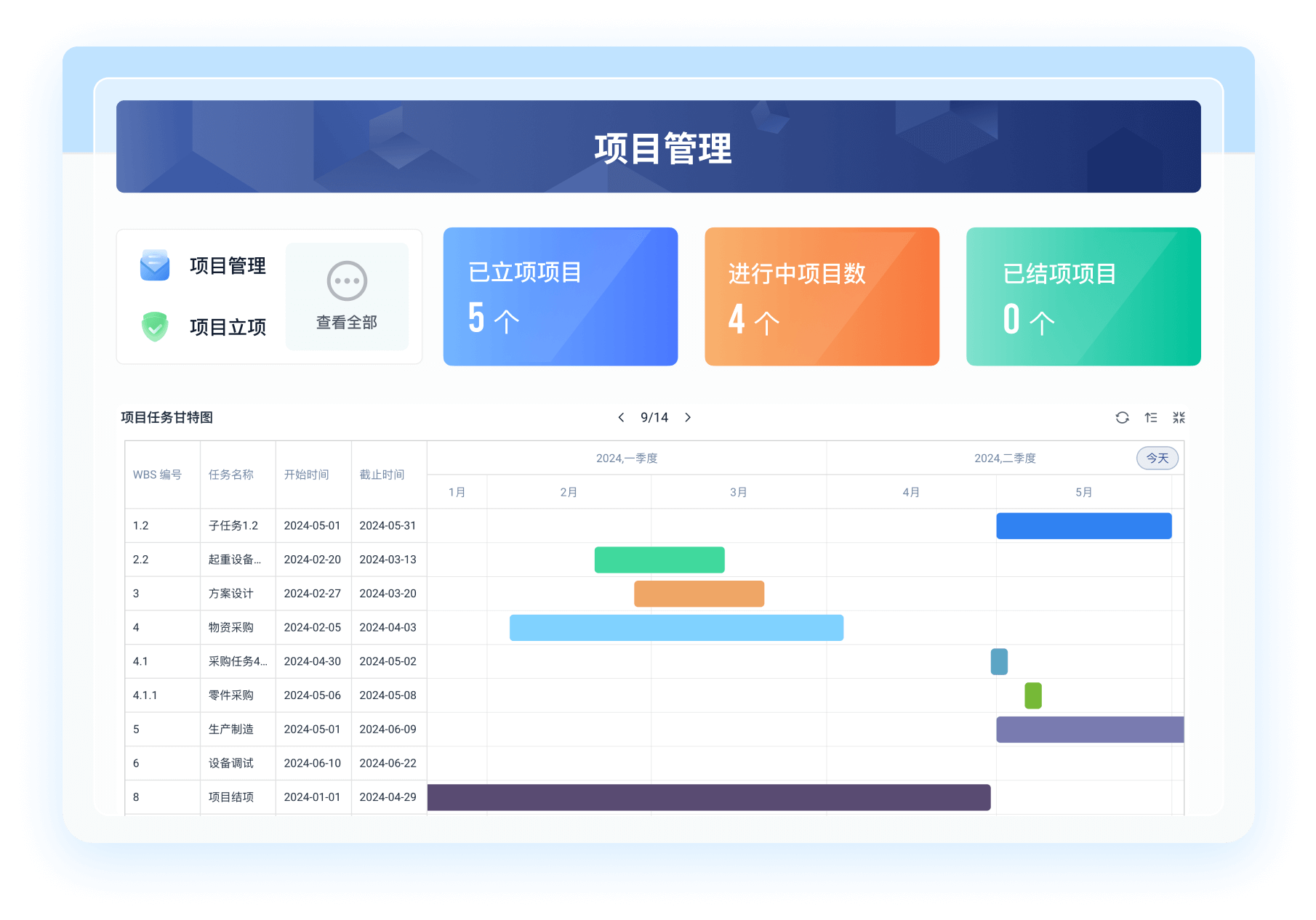

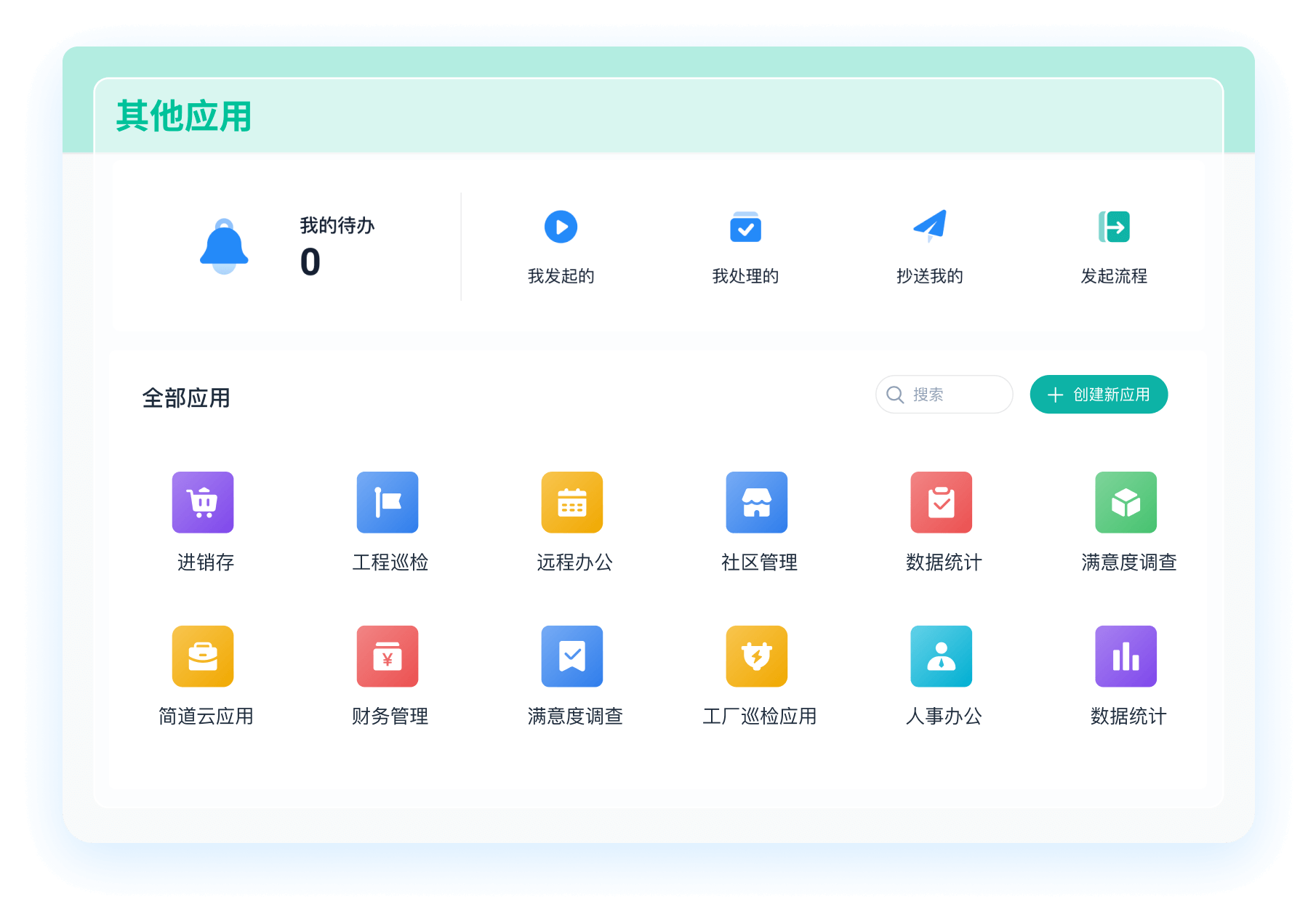

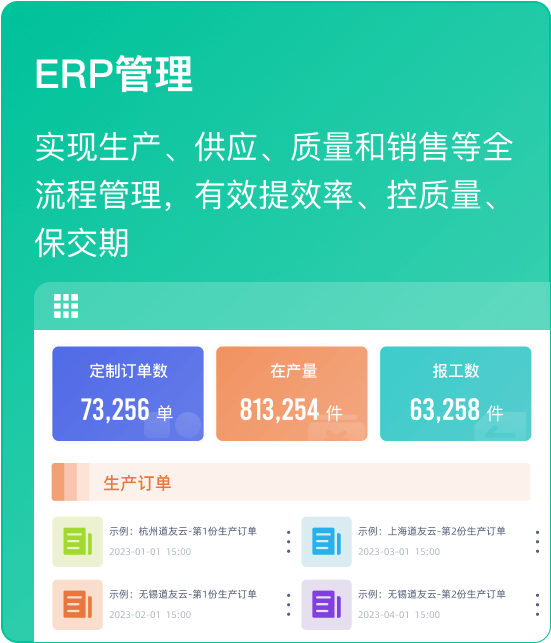

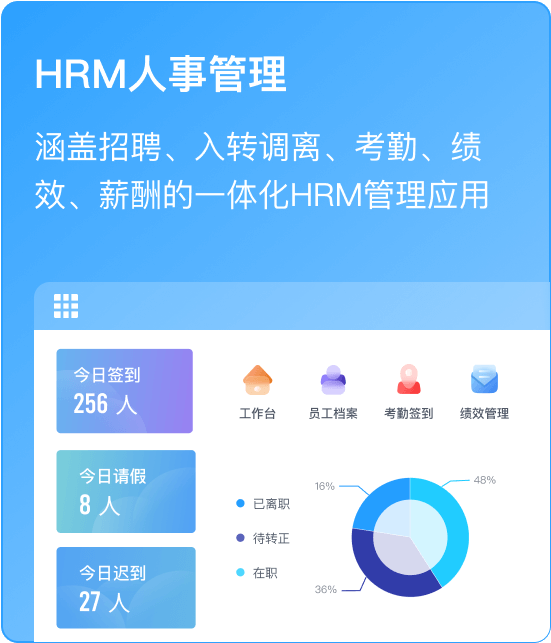

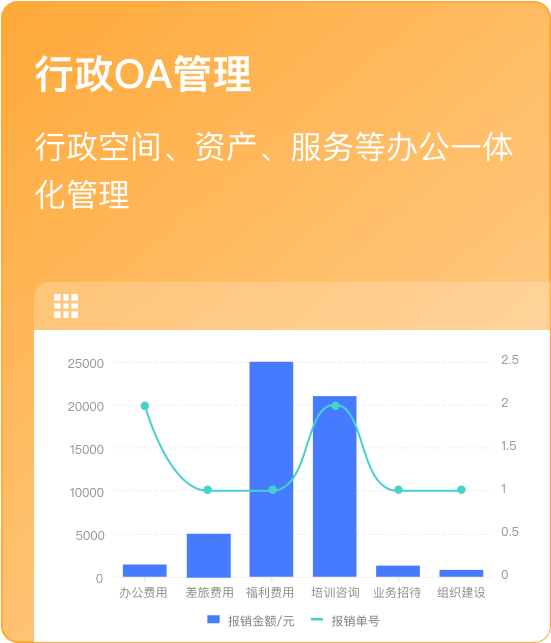

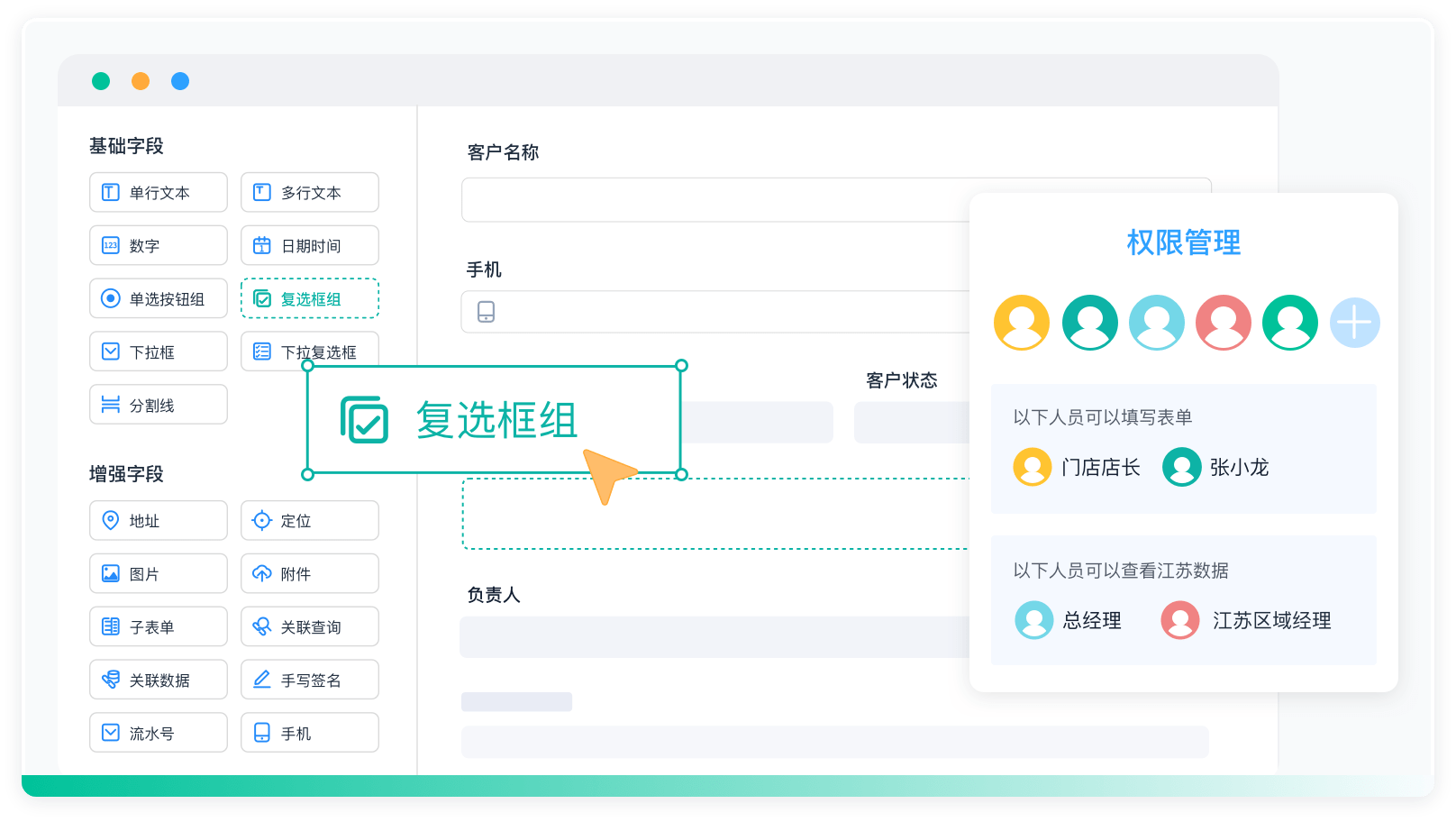

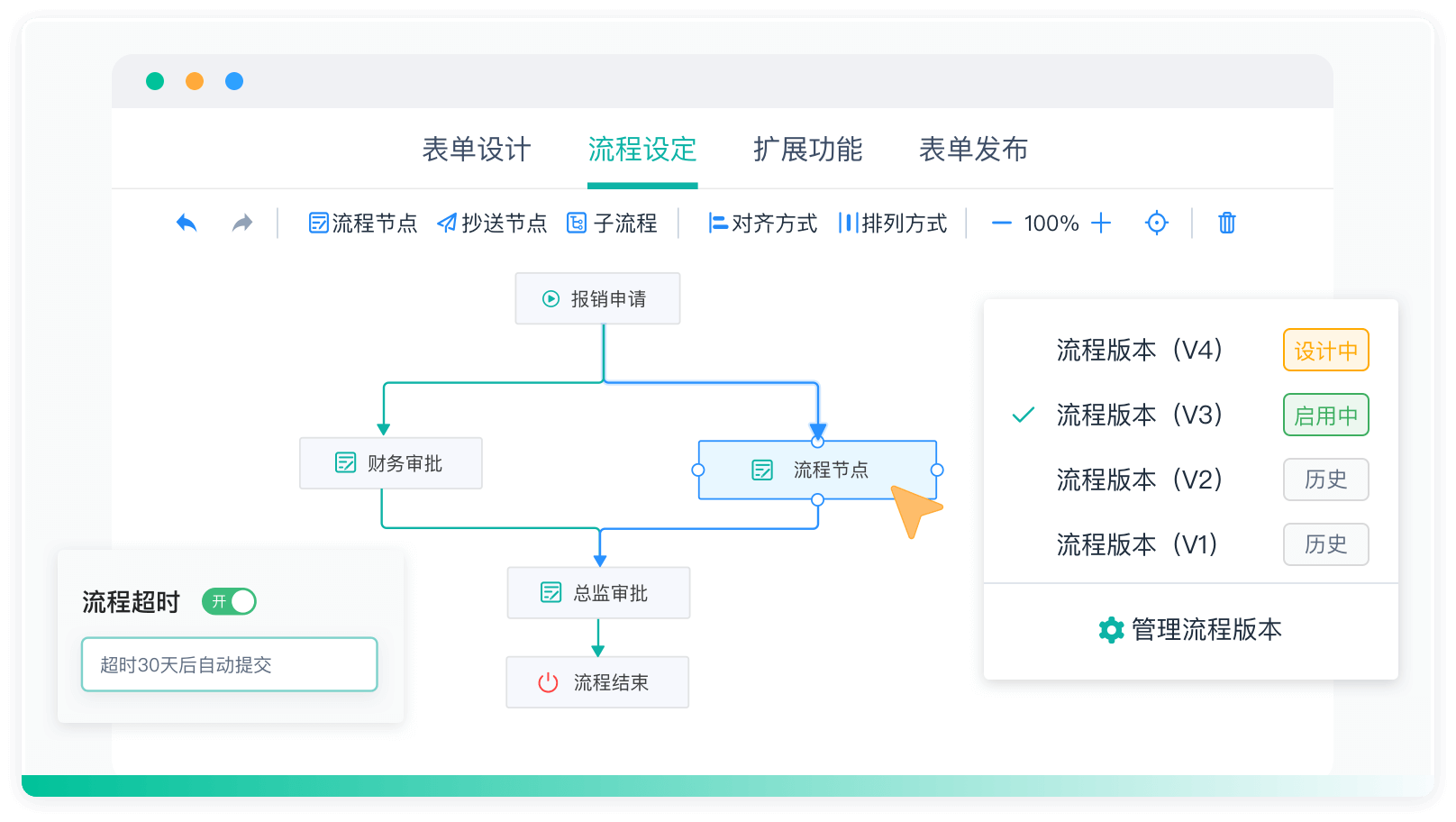

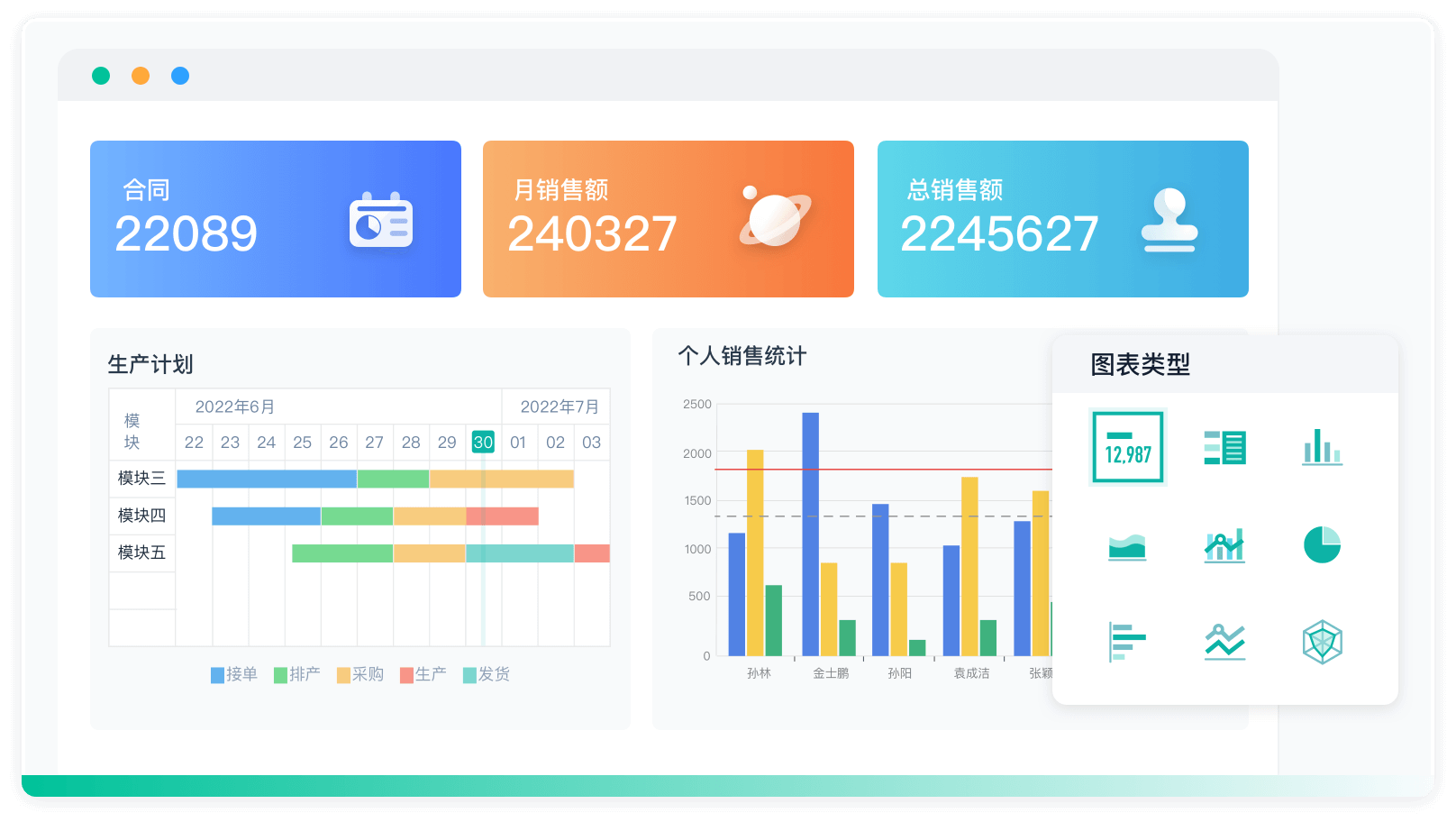

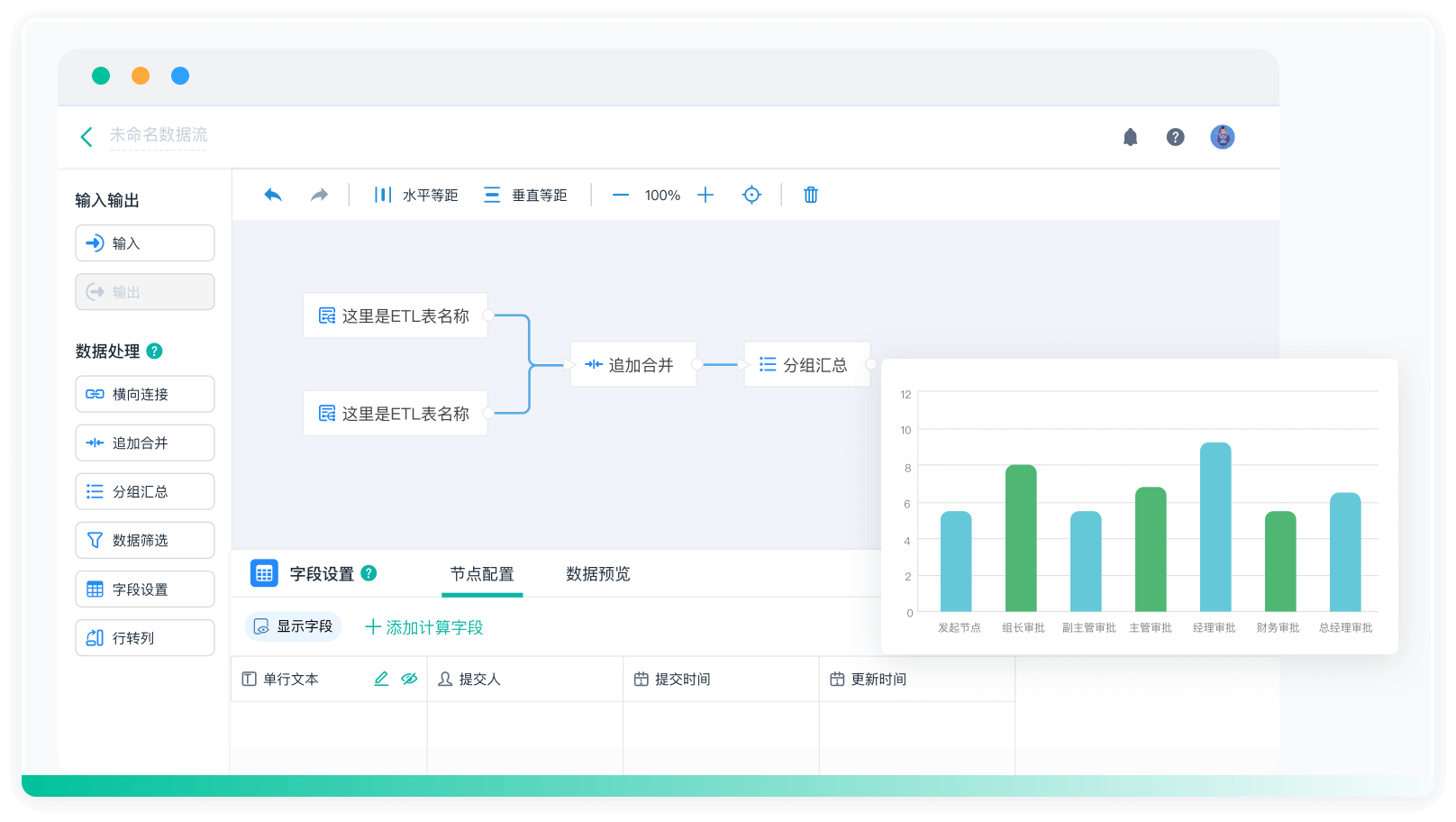

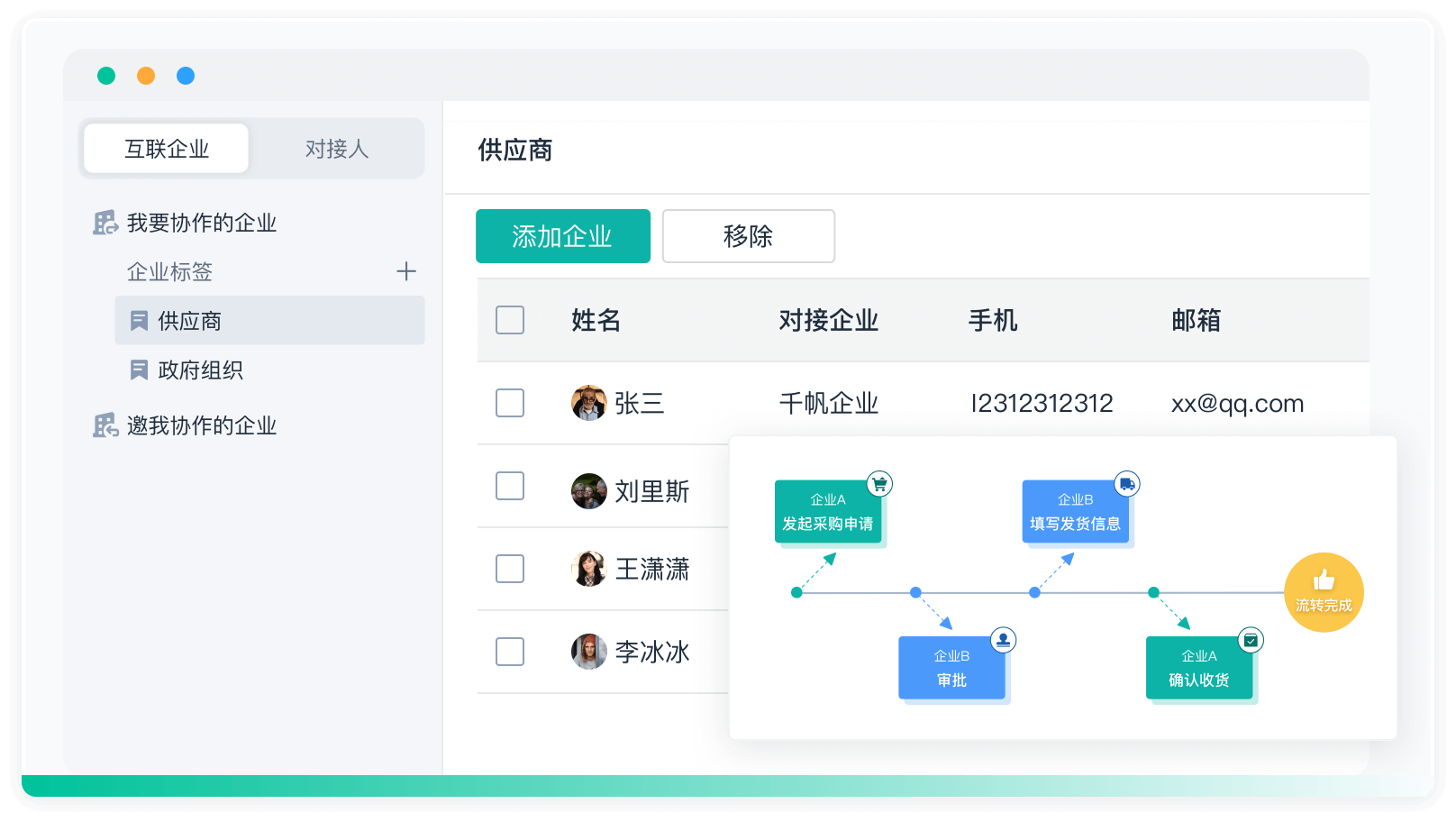

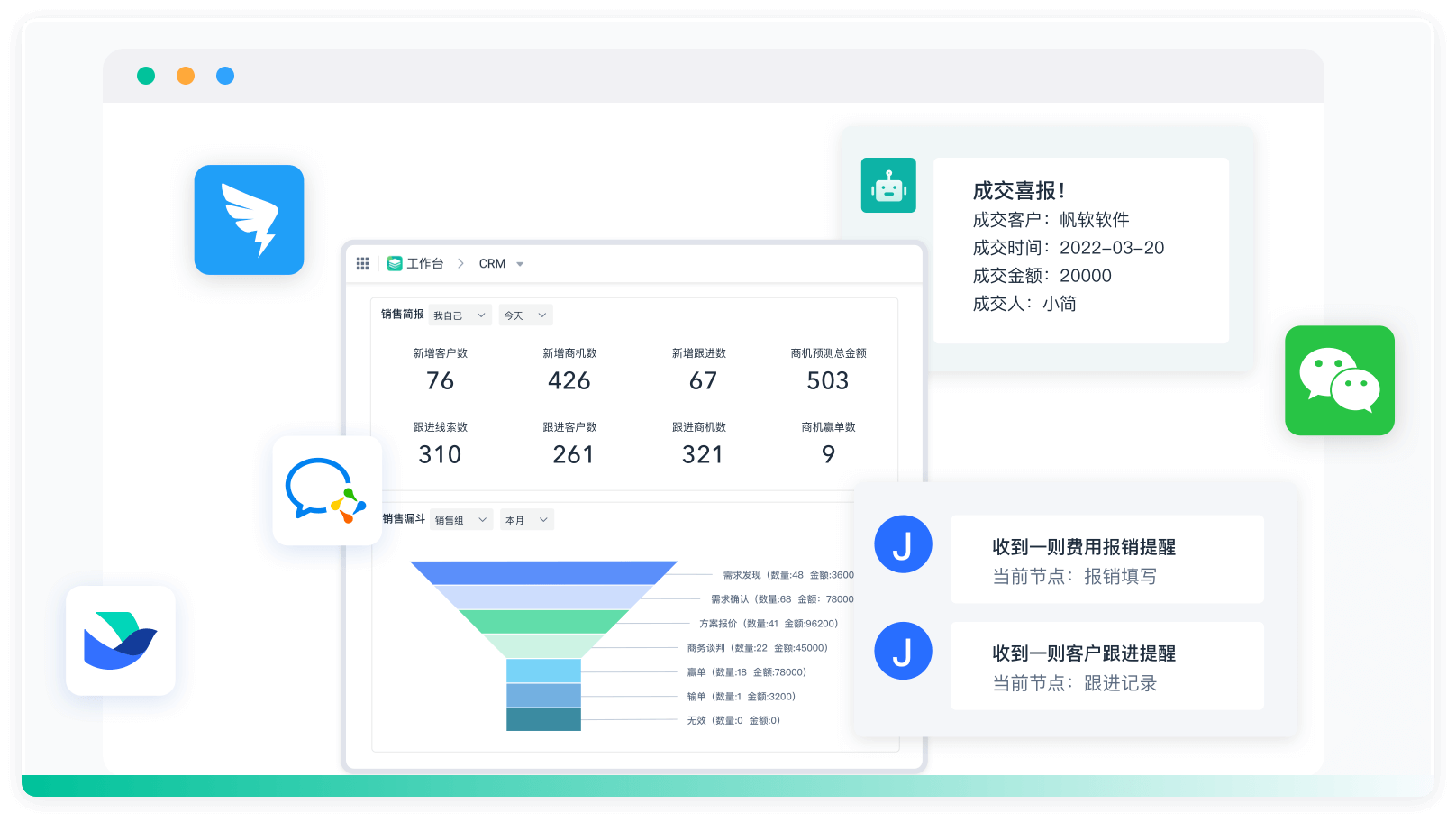

其中,简道云 作为一款低代码平台,适合需要集成数据管理和团队协作的用户。它不仅支持爬取数据的存储和可视化,还提供 API 接口,方便与其他系统对接。例如,用户可以利用 Python 编写爬虫,并通过 简道云 API 自动存入数据库,实现数据的统一管理。

简道云官网:https://www.jiandaoyun.com/register?utm_src=wzseonl

一、Scrapy:强大、可扩展的 Python 爬虫框架

Scrapy 是一款基于 Python 的开源爬虫框架,专为数据爬取和 Web 抓取设计。其优势包括:

- 高性能:异步架构,支持高并发爬取

- 可扩展性强:支持中间件、自定义 pipeline

- 支持多种数据格式:如 JSON、CSV、XML 等

Scrapy 的核心组件

| 组件 | 作用 |

|---|---|

| Spider | 定义爬取逻辑 |

| Downloader | 负责下载网页 |

| Middleware | 处理请求和响应 |

| Pipeline | 处理数据存储 |

Scrapy 适合有一定编程基础的开发者,能够高效地进行大规模数据爬取。

二、Octoparse:零代码爬虫,适合非技术人员

Octoparse 是一款可视化爬虫软件,适合不懂编程的用户。其主要特点包括:

- 零代码操作:拖拽式界面,适合小白

- 云端爬取:支持云端运行,无需本地维护

- 自动化功能:可设定定时任务,自动更新数据

Octoparse 适合电商、市场分析人员快速抓取网页数据,省去编写代码的复杂性。

三、ParseHub:智能云端爬虫,支持 JavaScript 渲染

ParseHub 主要用于处理 JavaScript 渲染的网页,如动态加载的网站。其特点包括:

- 云端运行:支持远程管理任务

- 强大的数据解析:可解析复杂的 HTML 结构

- 支持 API 集成:爬取结果可通过 API 获取

ParseHub 适用于需要处理复杂网页结构的用户,如爬取社交媒体、新闻网站等。

四、简道云:低代码集成,适合团队数据管理

简道云不仅能管理爬取的数据,还支持数据协作与分析,适合团队或企业用户。

简道云的主要功能

- 低代码数据管理:可视化表单和数据库管理

- API 支持:可通过 Python 代码与简道云数据表交互

- 团队协作:支持数据共享和权限控制

例如,用户可以使用 Scrapy 爬取数据,并通过 简道云 API 存入数据库,团队成员可实时查看和分析数据。

官网:https://www.jiandaoyun.com/register?utm_src=wzseonl

总结与建议

如何选择合适的爬虫管理软件?

| 需求 | 推荐工具 |

|---|---|

| 需要高性能、可扩展 | Scrapy |

| 零代码、可视化操作 | Octoparse |

| 处理动态网页 | ParseHub |

| 团队协作、数据管理 | 简道云 |

如果你是开发者,可以选择 Scrapy 进行高效数据爬取;如果不懂编程,Octoparse 更适合你。而需要管理数据并进行团队协作,简道云 是一个很好的选择!

相关问答FAQs:

爬虫管理软件哪个好?

在选择爬虫管理软件时,用户需考虑多个因素,包括易用性、功能强大、社区支持、价格等。市面上有许多爬虫管理工具,各有优缺点。以下是一些比较受欢迎的爬虫管理软件,供您参考:

-

Scrapy:这是一个开源的爬虫框架,使用Python编写。Scrapy功能强大,支持多线程抓取,能够处理复杂的网页结构。它的文档齐全,社区活跃,适合需要定制化爬虫的用户。对于初学者,Scrapy也提供了丰富的教程和示例。

-

Octoparse:这是一款无代码的爬虫工具,非常适合不具备编程基础的用户。Octoparse提供了可视化界面,用户可以通过拖拽的方式设计爬虫。同时,它也支持云端爬取,方便用户在不同设备上管理爬虫任务。

-

ParseHub:另一个无代码的解决方案,ParseHub同样提供了简单易用的界面。它支持从动态网页抓取数据,适合需要抓取JavaScript生成内容的用户。ParseHub还具备强大的数据导出功能,可以将数据导出为Excel、CSV等格式。

-

WebHarvy:这是一款用户友好的爬虫软件,适合没有编程经验的用户。WebHarvy通过点选方式帮助用户选择要抓取的数据,并且支持自动识别网页中的数据。它非常适合小型项目或个人用户使用。

-

Beautiful Soup:如果您是Python用户,Beautiful Soup是一个非常实用的库,它主要用于从HTML和XML文件中提取数据。虽然它需要一定的编程能力,但其灵活性和强大的功能使其成为许多开发者的首选。

-

Diffbot:这是一款基于人工智能的爬虫工具,能够自动识别网页的内容结构并提取数据。Diffbot适合需要处理大量数据且不希望手动维护爬虫的企业用户。

选择合适的爬虫管理软件,关键在于明确您的需求、技术能力以及预算。对于小型项目或个人使用,无代码工具可能更为方便。而对于需要定制化或处理复杂数据的项目,Scrapy或Beautiful Soup等编程框架则更为合适。

爬虫管理软件的主要功能有哪些?

爬虫管理软件通常具备多种功能,以下是一些主要功能的介绍:

-

数据提取:最基本的功能就是从网页中提取所需的数据。爬虫管理软件通过解析HTML或XML文档,提取文本、图片、链接等信息。

-

调度与管理:许多爬虫工具允许用户设置抓取的频率和时间,支持多任务并行抓取。用户可以设置爬虫在特定时间运行,或根据需要调整抓取策略。

-

数据存储与导出:提取的数据可以存储在数据库中,或以多种格式导出,如CSV、Excel、JSON等。不同软件在数据存储和导出方面的支持程度不同,用户可根据需求选择。

-

反反爬虫机制:一些高端爬虫管理软件提供应对反爬虫机制的功能,如IP代理切换、请求头伪装等。这些功能有助于提高爬虫的抓取成功率,避免被目标网站封禁。

-

可视化界面:对于无编程基础的用户,许多爬虫管理软件提供可视化界面,用户可以通过简单的点击和拖拽操作来设置爬虫,无需编写代码。

-

数据清洗与处理:一些爬虫工具还内置数据清洗功能,帮助用户对提取的数据进行去重、格式化等处理,以便于后续分析和使用。

-

API集成:部分爬虫管理软件支持与其他系统的API集成,用户可以将抓取的数据直接传输到其他应用程序中,提升数据利用效率。

-

错误监控与日志记录:高效的爬虫工具通常具备监控和日志记录功能,帮助用户了解抓取的状态和遇到的问题,以便于后续的调试和优化。

选择合适的爬虫管理软件时,用户应根据自己的需求与技术水平,综合考虑这些功能的实用性与便利性。

使用爬虫管理软件需要注意哪些问题?

在使用爬虫管理软件进行数据抓取时,有几个重要的问题需要注意,以确保抓取过程的顺利进行和合法性:

-

遵守网站的robots.txt协议:几乎所有的网站都会在根目录下放置一个robots.txt文件,规定了哪些内容允许爬取,哪些内容禁止爬取。在进行数据抓取前,务必检查并遵循这些规定,以避免侵权。

-

避免对服务器造成负担:在使用爬虫时,避免频繁请求同一网页,以免对目标网站造成过大负担。建议设置合理的抓取间隔时间,遵循礼貌爬虫的原则。

-

关注数据隐私和法律法规:在抓取涉及个人信息的数据时,务必遵守当地的隐私保护法律法规,如GDPR等,确保抓取行为的合法性。

-

处理反爬虫机制:许多网站会采取反爬虫机制来保护自身数据,常见的有IP封禁、验证码等。用户在使用爬虫管理软件时,需要了解并准备应对这些机制的方法。

-

定期维护和更新爬虫:随着网站结构的变化,原有的爬虫可能会失效。因此,定期检查和维护爬虫代码,确保其能够正常工作是非常重要的。

-

数据存储安全:抓取到的数据可能涉及商业机密或敏感信息,务必采取相应措施确保数据的安全存储,防止数据泄露。

-

测试与调试:在正式运行爬虫之前,进行充分的测试与调试,确保爬虫能够正常提取数据且不会对目标网站造成过大的影响。

-

了解行业规范与道德:在进行爬虫作业时,了解行业内的规范和道德标准,尊重他人的知识产权,不抄袭或非法使用抓取到的数据。

通过遵循这些注意事项,用户可以更有效地使用爬虫管理软件,确保数据抓取的合法性和效率。

在选择适合的爬虫管理软件时,考虑自身需求、预算及技术水平是至关重要的。希望以上信息能帮助您做出明智的选择。

最后推荐:分享一个好用的业务管理系统,注册直接试用:

https://www.jiandaoyun.com/register?utm_src=wzseonl

100+企业管理系统模板免费使用>>>无需下载,在线安装:

https://s.fanruan.com/7wtn5

阅读时间:5 分钟

阅读时间:5 分钟  浏览量:2345次

浏览量:2345次

《零代码开发知识图谱》

《零代码开发知识图谱》

《零代码

新动能》案例集

《零代码

新动能》案例集

《企业零代码系统搭建指南》

《企业零代码系统搭建指南》