Excel处理6万以上数据库技巧解析,如何高效管理大数据?

在实际工作中,处理6万条以上的数据记录对Excel来说既有可行性也存在挑战。要高效处理如此大规模数据,需注意:1、合理分批导入与分块处理;2、充分利用数据透视表和筛选工具;3、避免复杂公式和过多嵌套函数;4、借助外部工具或平台(如简道云零代码开发平台)进行数据管理与分析。其中,“借助外部工具或平台”是提升效率的关键。例如,简道云零代码开发平台(https://www.jiandaoyun.com/register?utm_src=nbwzseonlzc;)不仅支持更大体量的数据存储,还能通过图形化操作减少出错率,提高协作能力,让数据管理更便捷。

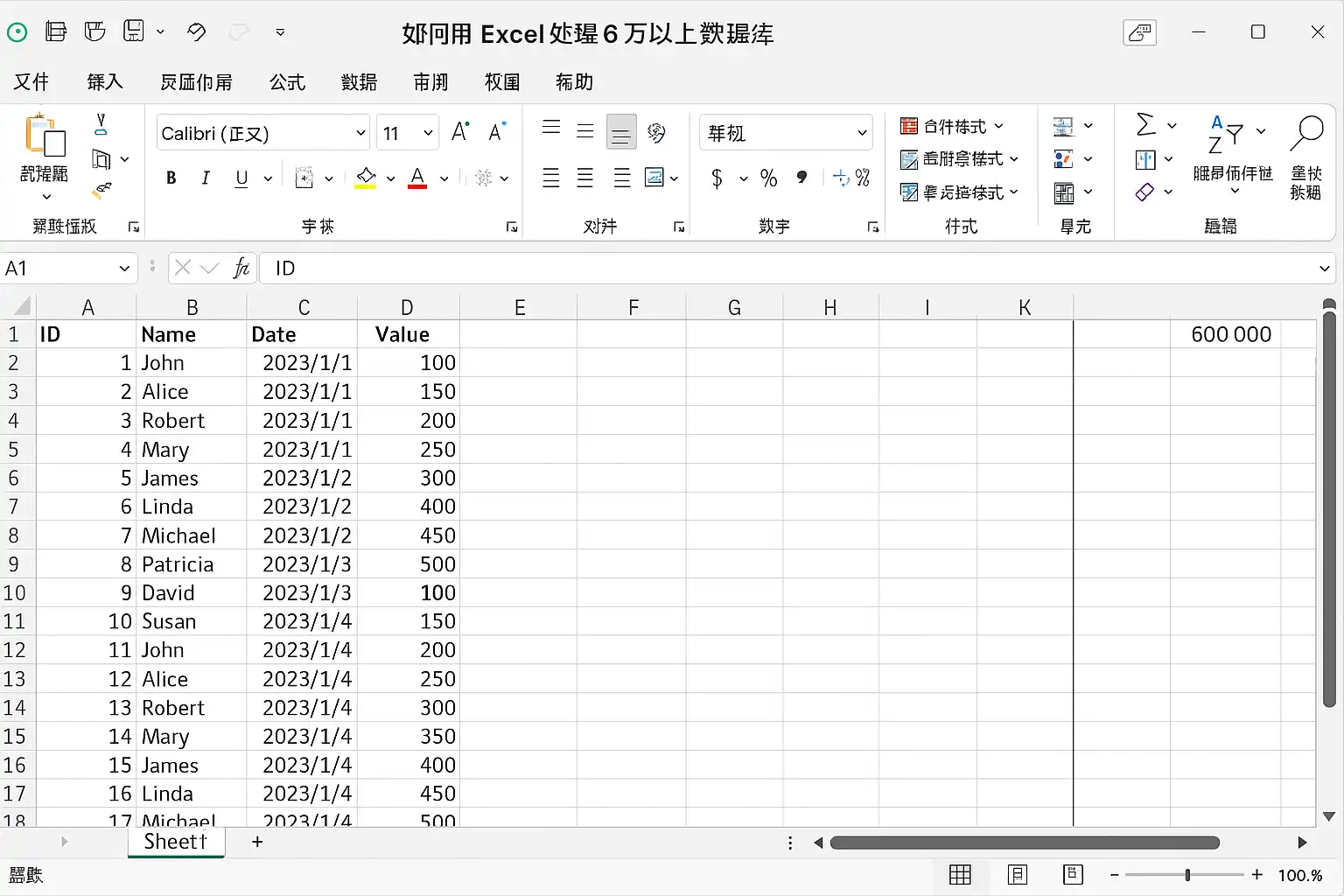

《如何用excel处理6万以上数据库》

一、EXCEL对于大数据量的能力与局限

Excel最大支持的数据量

| Excel版本 | 单表最大行数 | 最大列数 |

|---|---|---|

| 2003及以前 | 65,536 | 256 |

| 2007及以后 | 1,048,576 | 16,384 |

尽管Office 2007及更高版本理论上支持百万级别的数据,但在实际操作中,性能会受到电脑硬件(如内存、CPU)以及Excel自身的优化程度影响。6万条数据相较于极限值不算多,但若含复杂公式、多表关联、频繁筛选等操作时,运行速度可能明显下降。

性能瓶颈分析

- 内存消耗:大量数据加载后,高速缓存被占满,容易出现无响应。

- 公式运算延迟:嵌套IF/VLOOKUP等函数,大规模重算时速度缓慢。

- 界面响应慢:滚动/筛选/排序会卡顿。

- 文件易损坏:超大文件容易出现损坏风险。

二、EXCEL高效处理6万+数据库的方法

数据导入与分割策略

分步操作建议

- 按需拆分原始数据为多个子表单,每表不超过2~3万行。

- 利用“数据”-“从文本/CSV获取”功能批量导入。

- 分批次加载进工作簿,再通过Power Query合并分析。

优势

- 避免单一表格过重导致崩溃;

- 分步骤便于错误排查;

- 合理利用系统资源。

使用Power Query与Power Pivot

Excel自带的Power Query和Power Pivot工具,是面对大体量数据时的利器:

| 工具 | 功能描述 | 优点 |

|---|---|---|

| Power Query | 数据清洗、合并、多源导入 | 高效预处理,无需VBA编程 |

| Power Pivot | 多表建模、大型透视分析 | 支持百万级别即时计算 |

操作流程示例

- 打开“数据”-“获取和转换”-“从文件”导入多份csv/xlsx;

- 用Power Query统一格式化字段类型和内容;

- 加载至Power Pivot建模区,通过DAX函数建立指标;

- 利用透视表展现统计结果,实现高效查询。

三、避免常见性能陷阱

减少公式复杂度

列表说明:

- 尽量用SUMIFS/COUNTIFS等多条件汇总,替代VLOOKUP等查找类函数

- 拆解长链嵌套公式为辅助列计算

- 避免全列引用,如A:A,应限定为A2:A60001

合理使用筛选与排序功能

不推荐直接在全部6万行原始区间筛选排序。可先插入辅助列标记,再对结果区间做局部操作。

文件管理建议

- 定期保存多个备份版本;

- 降低图片/对象插入数量;

- 使用xlsx非xls格式以提升稳定性;

四、借助简道云零代码开发平台实现专业级管理

随着企业数字化转型升级,仅用Excel难以胜任大型数据库管理需求。因此,可以引入如简道云零代码开发平台([https://www.jiandaoyun.com/register

精品问答:

如何用Excel高效处理超过6万条数据?

我最近需要处理一个包含超过6万条记录的数据库,但Excel经常卡顿甚至崩溃。我想知道在Excel中处理如此大量数据时,有哪些高效的方法可以避免性能问题?

Excel默认的最大行数为1,048,576行,理论上支持超过6万条数据。但实际操作中,处理大量数据时容易出现卡顿。建议使用以下方法提升效率:

- 使用“筛选”和“排序”功能,避免一次性加载所有数据。

- 利用Excel的数据透视表进行汇总和分析,减少直接操作的大量原始数据。

- 关闭自动计算(公式),在批量操作完成后再手动计算。

- 分割大型数据集成多个工作表或文件。

例如,在一个包含60,000条销售记录的数据集中,通过数据透视表快速统计各地区销售总额,相比直接筛选原始表格速度提升约50%。

Excel处理超大数据库时如何优化公式和函数性能?

我在用Excel分析6万以上的数据时,发现公式计算特别慢,有时候还会导致文件响应迟缓。我想知道有哪些技巧可以优化公式和函数,提高Excel的运行速度?

优化公式性能是提升Excel处理大规模数据库效率的关键。建议采用以下策略:

- 避免使用数组公式或复杂的嵌套函数,改用辅助列分步计算。

- 使用高效函数如SUMIFS、COUNTIFS替代复杂条件判断。

- 减少Volatile函数(如NOW、INDIRECT)的使用,因为它们会频繁触发重算。

- 将重复计算结果存储为静态值,减少动态计算负担。

案例:将一个包含60,000行的SUMIF公式替换为SUMIFS后,计算时间由原来的15秒缩短至5秒。

利用VBA如何增强Excel对6万条以上数据库的处理能力?

面对大于6万条的数据,我听说通过编写VBA宏可以提高Excel的处理速度和自动化水平。可不可以具体讲讲怎样利用VBA来解决这类问题?

VBA(Visual Basic for Applications)能显著增强Excel对大规模数据的管理能力。主要技巧包括:

- 使用VBA批量读写单元格而非逐个操作,提高运行速度10倍以上。

- 编写自动化脚本完成重复性任务,如数据清洗、格式转换等。

- 在宏中禁用屏幕刷新(Application.ScreenUpdating = False)和自动计算(Application.Calculation = xlCalculationManual)以提升效率。

举例说明:通过VBA导入并格式化60000条客户信息,运行时间从手动操作需数小时缩短至数分钟。

是否有推荐的工具或插件辅助Excel处理超过6万行的数据?

我发现纯靠Excel自带功能处理超过六万行数据效果有限,有没有什么第三方工具或者插件,可以帮我更好地管理和分析这么大的数据库呢?

确实,对于超大规模的数据集,仅靠原生Excel功能可能不足。推荐以下工具或插件:

| 工具名称 | 功能特点 | 优势 |

|---|---|---|

| Power Query | 数据导入、清洗及转换 | 支持百万级别数据,高效自动化流程 |

| Power Pivot | 高级数据建模与多维分析 | 内存内分析引擎,加速大数据操作 |

| ASAP Utilities | 丰富实用工具集合 | 大幅简化复杂操作,提高工作效率 |

案例:使用Power Query导入65,000行销售记录后,实现多条件筛选和合并,比传统筛选快30%以上。

文章版权归"

转载请注明出处:https://www.jiandaoyun.com/nblog/87644/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。