Excel删除两列重复数据库技巧,如何快速高效去重?

在Excel中删除两列的重复数据,可以通过1、使用“删除重复项”功能;2、借助辅助列公式;3、利用筛选与排序操作等多种方式来实现。其中,“删除重复项”功能是最简便和高效的方法,适用于大部分场景。只需选中目标数据区域,点击“数据”选项卡中的“删除重复项”,勾选需要比对的两列,即可一键清除重复记录。以此方法为例,其优势在于操作直观、效率高,并能直接保留唯一值,避免手动筛查的繁琐步骤。对于更复杂的数据需求,还可以结合Excel的高级筛选或VBA脚本自动化处理。本文将详细解析各个方法,并结合实际应用场景,指导用户精准、高效地管理两列间的重复数据库。

《excel如何删除两列重复数据库》

一、EXCEL中删除两列重复数据的核心方法

常用方法及其特点:

| 方法 | 操作步骤 | 适用场景 | 优点 | 缺点 |

|---|---|---|---|---|

| 1. 删除重复项功能 | 数据区域→数据→删除重复项→勾选两列→确定 | 简单去重,两列全匹配时删重行 | 快速、一键完成 | 对部分匹配无效 |

| 2. 辅助列公式去重 | 新增辅助列,用公式判重(如=A2&B2),再根据唯一性筛选/删行 | 需自定义判重逻辑时(如仅部分字段) | 灵活,可扩展判重条件 | 操作稍复杂 |

| 3. 筛选与排序法 | 排序后用条件格式/筛选找出相同,再选择性删除 | 数据量较大或需人工判断时 | 可人工干预控制细节 | 效率略低 |

| 4. 高级筛选 | 利用“高级筛选”进行去重操作 | 要保留原始数据副本或特殊条件过滤时 | 可复制至新表,灵活多样 | 步骤较多 |

| 5. VBA脚本 | 编写宏自动检测并移除双列重复 | 批量处理、自动化需求 | 自动化高效,批量处理适合大量数据 | 学习门槛高 |

二、详细操作演示:使用“删除重复项”功能去除双列重复

- 准备数据

-

假设有如下表格(A、B两列为待查重对象):

A B 张三 销售部 李四 技术部 张三 销售部 王五 财务部 李四 技术部

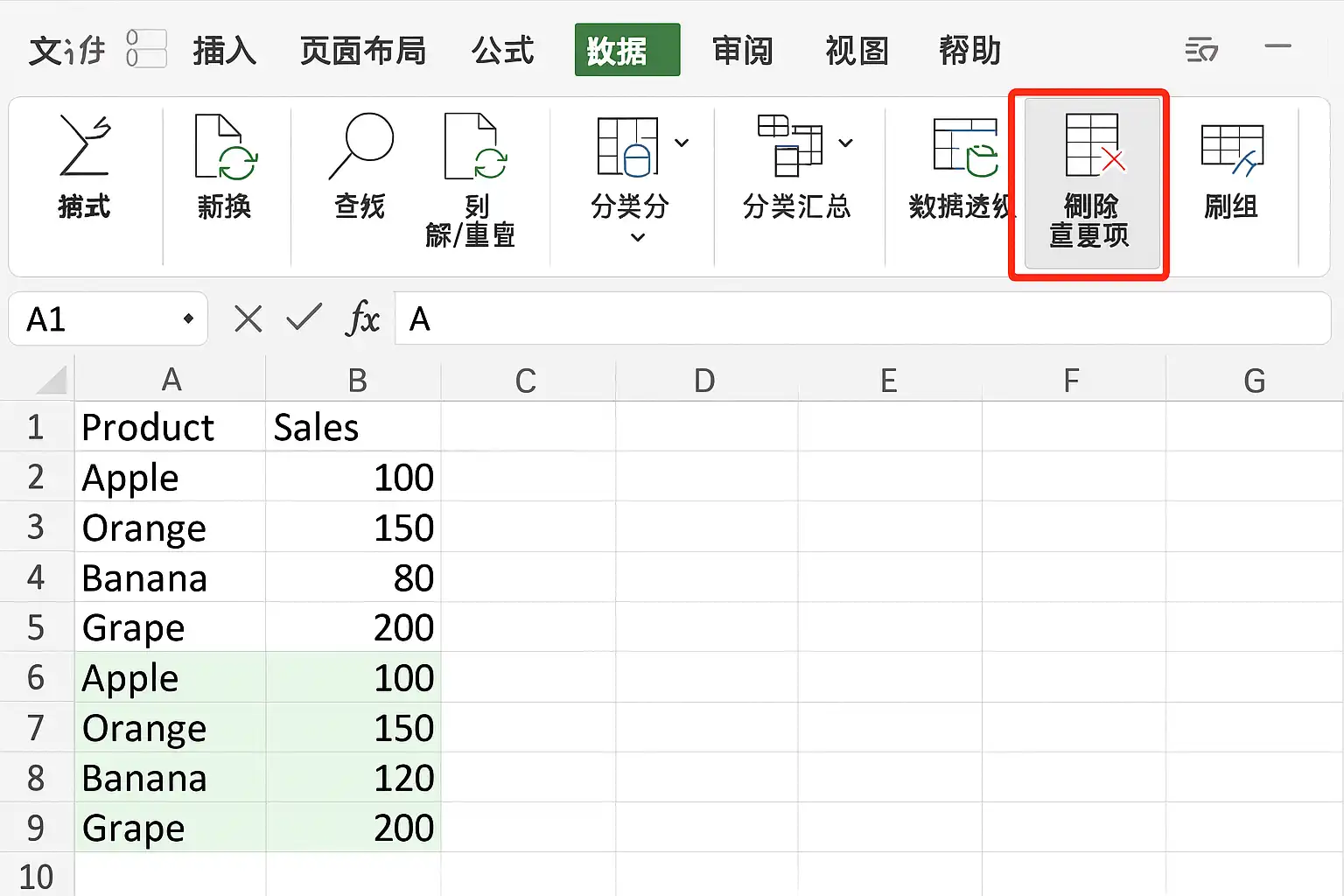

2. **选择数据区域**- 用鼠标框选A、B两列包含内容的数据区域(建议不要包含表头)。

3. **点击菜单栏“数据”**- 在Excel顶部菜单栏选择“数据”。

4. **选择并点击“删除重复项”按钮**

5. **弹窗设置**- 在弹窗内确保已勾选“A”和“B”,即按这两列联合查找完全一样的数据行。

6. **确认执行**- 点击确定,系统会自动识别并保留每组A+B唯一组合的首条记录,其余同组记录被移除。

7. **结果示例:**A B 张三 销售部 李四 技术部 王五 财务部

**特别提示:**- 删除是不可逆操作,请提前备份原表或使用撤销功能。- 若存在表头,请确保首行为标题并在弹窗内勾选相关设置。

---

## 三、**辅助公式与自定义判重方案**

对于更灵活、更复杂的数据判定,可以借助辅助公式完成。例如,仅当A+B完全相同时视为重复,可用如下方法:

1. **新增辅助列C**

2. **输入合并公式:**=A2&B2

或者,为防止混淆,用分隔符:=A2&”_“&B2

3. **向下填充整个C列**

4. **用COUNTIF判断是否有多个相同组合**

5. **可添加新一辅助D:“=COUNTIF(C:C, C2)”判断出现次数**

6. **依据D>1进行筛选,再批量删除行,只保留首次出现的组合。**

这种方案对于字段内容复杂、有空格等情况尤为有效,也便于后续扩展,如多字段联合判重。

---

## 四、**利用高级筛选和排序实现精准去重**

当需要将唯一值复制到新位置、不影响原始数据库时,高级筛选很实用:

1. 框定要查找的数据范围。2. 菜单栏点开【数据】→【高级】。3. 在弹窗里设定:- “将结果复制到其他位置”- “不选择唯一记录”4. 指定目标输出区域。5. 勾上“两列”为条件字段,实现完全一致才视为副本。6. 确认即可获得无双列表副本。

此法特别适用于报告生成和临时分析,不会破坏源表结构。

---

## 五、**VBA脚本与批量自动化处理方案**

对于数据库极大或者需要经常性批量执行清理任务,可利用如下VBA宏脚本:

```vbaSub RemoveDuplicatesTwoColumns()Dim ws As WorksheetSet ws = ActiveSheet

'假设需要查找A和B两类所有内容所在区域(第1-1000行为例)ws.Range("A1:B1000").RemoveDuplicates Columns:=Array(1, 2), Header:=xlYes

End Sub- 用法:

Alt + F11打开VBA编辑器,新建模块粘贴代码,然后运行即可。 - 可根据实际需求调整范围和参数,实现更精细管控。

六、简道云零代码开发平台助力企业级Excel数据库管理升级

随着业务流程数字化升级,仅靠Excel手工处理已难以满足大型企业对数据库管理的高效与安全需求。这时推荐使用简道云零代码开发平台——一个无需编程基础即可搭建各类企业应用系统的平台。它支持自定义表单、多维度关联分析、大规模协作共享以及权限管控等强大能力,让企业轻松完成包括去重在内的数据加工及流程自动化任务。如需体验更多智能模板及在线工具,可访问其官网:https://www.jiandaoyun.com/register?utm_src=nbwzseonlzc;

七、常见问题解答与进阶技巧说明

- Q:如果仅部分字段一致是否可认为是“重复”? A:可以,通过辅助手段(如自定义公式或高级筛选),可以灵活设定哪些字段作为比对标准。

- Q:怎样避免误删? A:强烈建议先备份原始表格,或先在副本上练习操作流程,无误后再正式处理主库。

- Q:如何处理千万级以上超大库? A:推荐借助更专业的大数据平台,如SQL Server/MySQL/简道云等进行分布式运算及存储管理,彻底解决性能瓶颈。

总结与建议

综上所述,在Excel中去除两列表中完全一致的数据库记录,有多种有效途径。在日常办公场景下,“删除重复项”是最高效且易于掌握的方法;而通过辅助公式、高级筛选甚至VBA脚本,则可满足更复杂、多变的数据清洗需求。如果您的业务对效率、安全性有更高要求,不妨试试像【简道云】这样的零代码平台,实现真正智能、高效且可扩展的数据管理体系!

最后推荐:100+企业管理系统模板免费使用>>>无需下载,在线安装: https://s.fanruan.com/l0cac

精品问答:

Excel如何删除两列重复数据库中的重复项?

我在处理Excel数据库时,发现有两列数据存在重复项,想知道应该如何删除这两列中重复的记录,保证数据库的唯一性,有没有简单有效的方法?

在Excel中删除两列重复数据库中的重复项,可以使用“条件格式”或“删除重复项”功能。具体步骤如下:

- 选中包含两列数据的整个数据区域。

- 点击菜单栏的“数据”标签。

- 选择“删除重复项”,弹出窗口后勾选需要检查的两列。

- 点击确定,Excel将自动删除基于这两列组合的重复记录。

此方法基于Excel内置算法,能高效处理数千行数据,减少手动筛查时间。

使用Excel函数能否实现删除两列重复数据库中的数据?

我想通过Excel公式来标记或过滤出两列中重复的数据,但是不确定哪些函数组合能准确识别并辅助删除,这样可以理解操作原理并灵活应用吗?

可以利用Excel函数如COUNTIFS来标记和定位两列中的重复记录。具体做法:

- 在新的一列输入公式:=COUNTIFS(A:A, A2, B:B, B2) ,这里假设A、B为要检测的两列。

- 向下填充公式,如果返回值大于1,表示该行在这两个字段组合下是重复的。

- 利用筛选功能筛选出计数大于1的行,然后手动或批量删除这些行。

这种方法适合动态监控和复杂的数据清洗场景,但相较直接使用“删除重复项”功能,需要更多操作步骤。

怎样通过VBA宏自动化处理Excel中两列重复数据库的去重?

我对VBA编程有一定了解,希望用宏自动化清理包含大量行的Excel数据库里的双列重复数据,请问有没有高效且代码示例?

可以编写VBA宏实现自动删除两列组合条件下的重复行。示例代码如下:

Sub RemoveDuplicatesTwoColumns() Dim ws As Worksheet Set ws = ThisWorkbook.Sheets("Sheet1") '修改为目标工作表名称 ws.Range("A1:B" & ws.Cells(ws.Rows.Count, "A").End(xlUp).Row).RemoveDuplicates Columns:=Array(1, 2), Header:=xlYesEnd Sub此宏调用了Range对象自带的RemoveDuplicates方法,根据第一、二列联合判断并去除相应行。适用于超大规模数据,提高效率且减少人为失误。

为什么Excel“删除重复项”功能只针对单个工作表有效,不支持跨表去除两列表格中的重复?

我有两个不同工作表分别存储相关的数据,两者都有可能存在某些相同记录,我想知道是否能直接用’删除重复项’功能跨表处理,或者有什么替代方案?

Excel内置‘删除重复项’功能是基于当前工作表范围进行操作,不支持跨多个工作表同时识别和去重。解决方案包括:

- 将两个表合并到同一工作表后,再执行‘删除重复项’操作。

- 使用Power Query工具导入多张表,通过合并查询实现跨表去重,其支持多维度联合判断,并且性能优越,适合大型数据库管理。

- 编写VBA脚本逐步比较两个工作表,并根据条件删减匹配记录,实现定制化需求。

文章版权归"

转载请注明出处:https://www.jiandaoyun.com/nblog/87841/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。