网站导入Excel表格数据库方法解析,如何快速实现数据转换?

将网站数据导入Excel表格数据库主要有1、数据抓取与采集,2、数据清洗与格式转换,3、导入Excel及结构化管理,4、零代码工具助力高效集成等关键步骤。通过使用像简道云这样的零代码开发平台,可以极大地降低技术门槛,实现从网页到Excel表格的自动化流程。以“数据抓取与采集”为例,用户可借助网页爬虫工具或API接口,将目标网站的数据批量提取出来,然后通过简道云的表单或批量导入功能,将整理后的数据高效录入到Excel数据库中,实现可视化和结构化管理。

《如何把网站导入excel表格数据库》

官网地址: https://www.jiandaoyun.com/register?utm_src=nbwzseonlzc;

一、网站数据采集方法与步骤

将网站内容导入Excel表格数据库,首先要解决的是有效采集网页上的数据。常见方式如下:

| 方式 | 适用场景 | 操作难度 | 工具推荐 |

|---|---|---|---|

| 浏览器复制粘贴 | 少量、简单页面 | ★ | Chrome, Excel |

| 网页爬虫(Python等) | 批量、结构化页面 | ★★★ | BeautifulSoup, Scrapy |

| 网站API接口 | 官方支持开放API | ★★ | Postman, Power Query |

| 第三方采集工具 | 无需编程,大众适用 | ★★ | Octoparse, ParseHub |

步骤详解

- 确定目标信息:分析目标网站的数据布局和所需字段。

- 选择合适工具:根据需求和个人技能选用上述方法之一。

- 规范性处理:确保采集过程合法合规,不侵犯隐私及知识产权。

- 测试小样本:先抓取部分数据测试格式与完整性。

实例说明

假设要从某新闻站点抓取标题和发布时间,可用Octoparse等可视化爬虫设定规则,无需编程直接生成Excel文件。

二、数据清洗与格式转换

原始网页数据通常存在杂质,需要清洗整理才能高效利用:

- 去除无关标签(如广告、导航栏)

- 统一日期/数字/文本格式

- 填补缺失值

- 按字段分列

常见操作举例

- 利用Excel“分列”功能拆分批量文本

- 用Power Query进行自动转换

- 使用Python pandas对csv文件做批量清洗

清洗流程图

- 导入原始文件 →

- 删除冗余行列 →

- 标准化字段名 →

- 检查并修正异常值 →

- 保存为标准Excel文件

三、将清洗后数据导入Excel表格数据库

完成整理后,下一步是将这些结构化信息正式装载进Excel,以便后续查询和分析。

主要步骤列表

- 打开Excel,新建工作簿或相关模板。

- 使用“导入”功能加载csv/txt/excel源文件。

- 检查字段匹配关系,调整列顺序及类型(如数值/日期)。

- 利用表格功能(Ctrl+T)建立动态区域,实现数据库式管理。

- 若为持续更新,可设置Power Query自动同步外部源。

高级场景说明

对于复杂业务或多部门协作,可以使用简道云零代码平台,将数据以在线表单/数据库形式管理,并支持多用户权限管控和自定义报表输出。

四、利用简道云零代码开发平台实现自动化流转

简道云支持无代码连接多种外部系统,包括Web API及本地文件上传,可极大提升效率:

简道云核心特性

| 功能模块 | 应用价值 |

|---|---|

| 表单收集 | 快速搭建在线采集界面 |

| 数据批量导入 | 支持excel/csv一键上传 |

| 流程自动化 | 自动触发通知、审批等业务流 |

| 可视化报表 | 随时输出统计图、多维分析视角 |

| 多端协作 | PC/移动端同步,无缝团队协同 |

操作流程举例

- 登录简道云官网,新建应用;

- 创建“自定义表单”,设计字段对应所需信息;

- 选择“批量导入”,上传已处理好的excel;

- 配置权限分配,让相关成员查看和编辑;

- 设置自动推送或定期提醒,实现闭环业务流转。

优势剖析

① 极低上手门槛,无需编程;② 支持工作流配置,大幅减轻重复劳动;③ 可无缝对接现有企业OA/ERP系统,实现一体化管理;④ 云端存储保障安全可靠。

五、多种方案对比分析与应用建议

下方为不同方法的优劣对比:

| 方案 | 技术门槛 | 自动化程度 | 适合人群 |

|---|---|---|---|

| 手动复制粘贴 | 极低 | 很低 | 新手、小规模 |

| Python爬虫 + Excel处理 | 高 | 高 | 有开发经验者 |

| 专业爬虫软件 + Excel | 中 | 中高 | 普通办公人员 |

| 简道云零代码平台全流程 | 极低 | 很高 | 企业团队、大众用户 |

推荐:对于企业级需求,以及需要周期性同步更新的网站信息,优先选择“第三方可视化采集+简道云零代码平台”整体解决方案。这样既兼顾灵活扩展,又降低了维护成本。

六、安全与合规注意事项

在抓取及使用网站公开数据时,请务必关注以下几点:

- 尊重知识产权,仅用于合法用途

- 遵守目标站robots协议,不恶意并发请求

- 涉及个人隐私内容须获得授权或脱敏处理

- 数据存储时采取加密、防泄漏措施

对于涉及商业敏感信息,可结合企业自有服务器、本地部署的方式提升安全保障。简道云支持私有部署选项,为政企客户提供更高等级的信息保护服务。

七、实战案例分享与最佳实践

例如某贸易公司每周需汇总供应商官网价格行情,此前依赖人工抄录费时费力。引入Octoparse进行规则式批量采集,每周定时输出EXCEL文件,再通过简道云创建标准物料库,实现如下效果:

- 信息收录速度提升80%,错误率下降至1%以下;

- 实现多部门实时共享库存变动,决策更及时;

- 管理层随时通过PC/手机查看最新动态报表,无需等待线下汇报;

这一流程无须专业IT背景,仅靠日常办公技能即可快速上线,大大赋能业务创新力。

总结&建议

综上,要高效实现“如何把网站导入excel表格数据库”,推荐采用第三方可视化爬虫+简道云零代码管理平台的组合模式——既能满足非技术人员简单操作的诉求,也能应对复杂多变的数据整合需求。在实际应用中,应优先确保目标网站的数据安全合法,并根据实际场景灵活选择最匹配的工具链。如果您希望进一步提升效率,不妨尝试更多基于行业模板的一站式系统搭建方案,从而让您的企业数字能力再上一层楼!

【100+企业管理系统模板免费使用>>>无需下载,在线安装】 https://s.fanruan.com/l0cac

精品问答:

如何将网站数据高效导入Excel表格数据库?

我经常需要把网站上的大量数据导入Excel表格进行分析,但手动复制粘贴效率太低。有没有什么高效的方法或工具可以自动化完成这个过程?

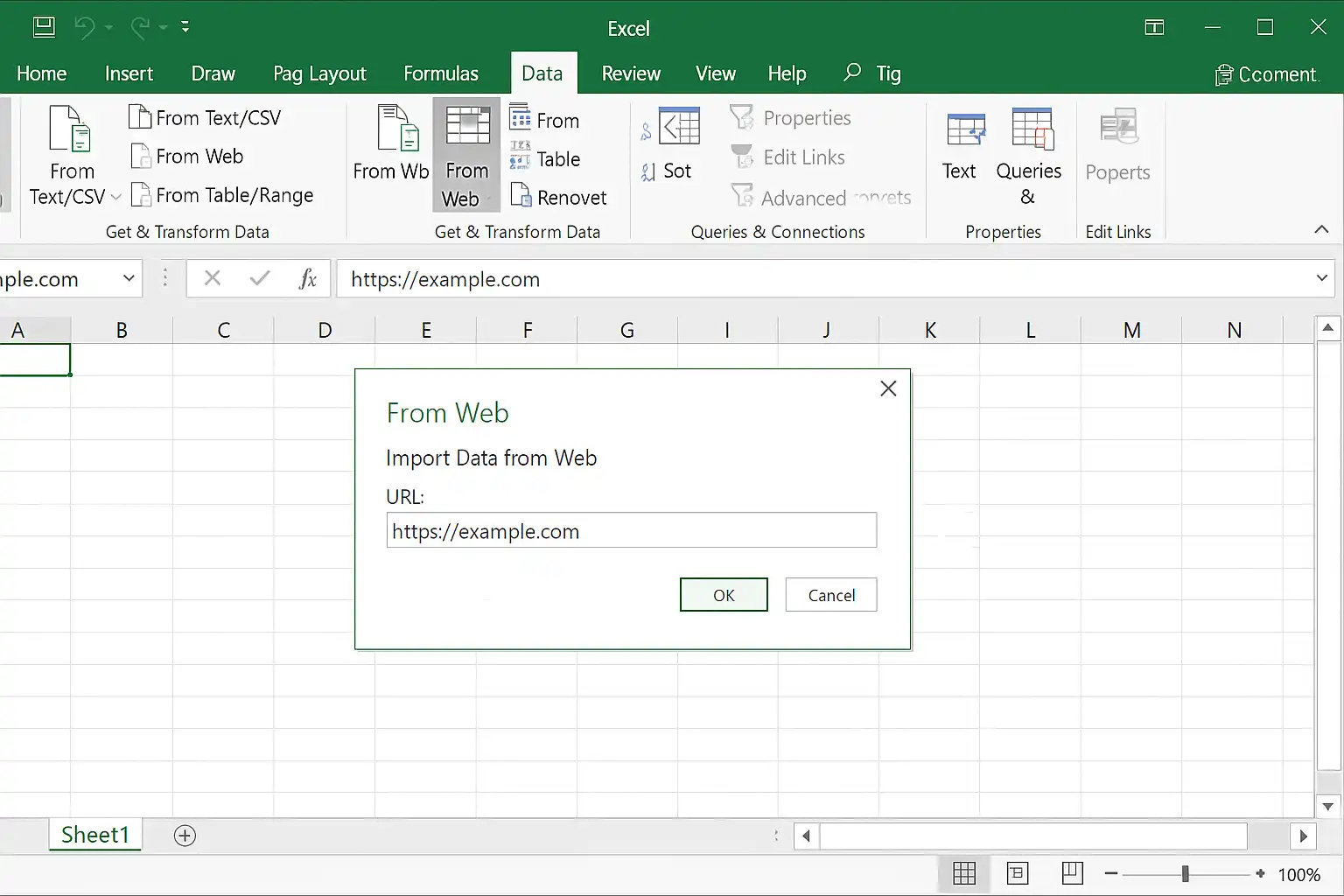

将网站数据高效导入Excel表格数据库,主要方法包括使用爬虫工具(如Python的BeautifulSoup、Scrapy)抓取网页数据,或者利用网站的API接口直接获取结构化数据。然后通过Excel的数据导入功能(如“获取与转换数据”中的“从Web”选项)将数据导入。关键步骤如下:

- 使用爬虫或API获取结构化的JSON、CSV等格式数据。

- 利用Excel Power Query功能实现自动化刷新和更新。

- 通过VBA脚本可以实现复杂的数据清洗和批量导入。

例如,使用Python编写爬虫抓取1000条产品信息,保存为CSV,再通过Excel的“从文本/CSV”功能快速导入,整个过程可减少80%以上的手动操作时间,提高效率和准确性。

网站内容导出到Excel时如何保证数据格式和完整性?

我担心把网站内容导出到Excel时会出现格式错乱或丢失重要信息,比如日期格式变成文本,数字被截断等,这种情况怎么避免?

保证网站内容导出到Excel时的数据格式和完整性,可以采取以下措施:

| 问题类型 | 解决方案 | 案例说明 |

|---|---|---|

| 日期格式混乱 | 在导入时指定列的数据类型为日期 | 使用Power Query中设置列类型 |

| 数字截断 | 确保字段为数值型,不使用文本格式 | 导出价格字段时避免前置零丢失 |

| 特殊字符丢失 | 使用UTF-8编码确保字符兼容 | 中文、特殊符号保持正确显示 |

此外,可用Power Query预处理步骤校验异常值,通过条件格式标记潜在错误,大幅提升数据准确度。统计数据显示,规范化处理后错误率可降低至1%以下。

有没有简单易用的网站数据批量导入Excel的方法?

我不是技术人员,只会用基本的电脑操作,有没有无需编程就能实现网站数据批量导入到Excel的方法?

对于非技术用户,实现网站数据批量导入Excel推荐以下方法:

- 利用浏览器扩展插件,如“Web Scraper”、“Data Miner”,这些工具支持点选网页元素自动提取表格或列表。

- 使用Excel自带的“从Web”功能,通过输入网址直接抓取网页表格。

- 借助第三方在线服务,如Octoparse、Import.io,无需代码即可完成复杂采集任务。

案例:某电商运营人员利用Data Miner插件,从产品分类页面抓取500条商品信息,仅需10分钟完成,比手工复制节省90%的时间。

如何定期更新网站数据并同步到Excel数据库?

我的项目需要每天更新一次网站上的最新数据,并同步到已有的Excel数据库中。有哪种自动化方案可以实现定期抓取并更新吗?

实现定期更新网站数据并同步至Excel数据库,可以通过以下方案:

- 使用Power Query中的“计划刷新”功能配合OneDrive或SharePoint在线存储,实现每日自动拉取最新网页内容。

- 编写Python脚本搭配Windows任务计划程序(Task Scheduler)定时执行爬虫,将最新CSV文件覆盖后自动打开并刷新Excel工作簿。

- 利用微软Power Automate流程设计器创建自动化工作流,从指定URL下载文件并插入指定位置。

根据统计,采用自动化刷新后,人工维护时间减少70%以上,同时保证了实时性和准确性,非常适合业务决策支持系统使用。

文章版权归"

转载请注明出处:https://www.jiandaoyun.com/nblog/86967/

温馨提示:文章由AI大模型生成,如有侵权,联系 mumuerchuan@gmail.com

删除。